“AI绘画在各个领域都能带来不同的赋能价值,我们也在不断探索AIGC的落地可能性,因为我们相信,未来是AI+的时代,它能重塑生产力、丰富我们的生活、工作,甚至人的精神世界。”——Jimmy

更多AI前沿科技资讯,请关注我们:

产品经理逛世界一只在互联网PM浪迹多年的吉米猫,希望与大家一起分享,一起成长,一起用发现的眼光看世界,用一颗产品心分析世间万物。个人资源分享网站:www.douyoubuy.cn 公众号

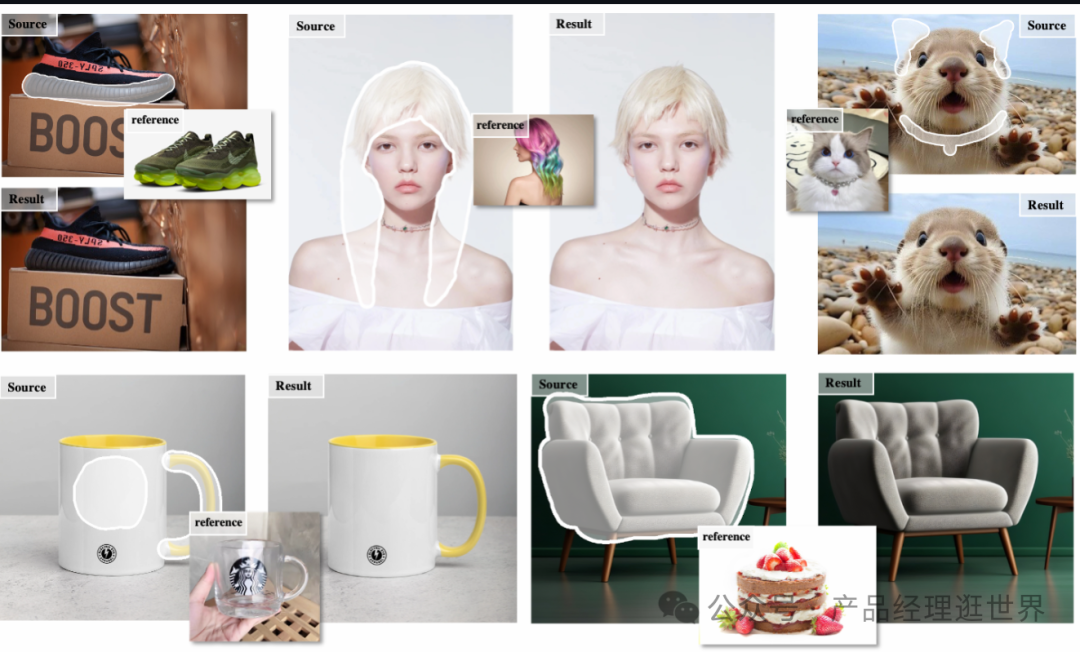

MimicBrush 是一项由香港大学、阿里巴巴以及蚂蚁集团联合开展的最新研究,提出了一种创新的图像编辑方法——模仿编辑。

这种方法针对图像处理领域中一个普遍存在的难题:当用户难以明确表达他们想要的图像效果时,如何进行有效的编辑。通过模仿编辑,研究团队成功地解决了这一挑战,为用户提供了一种更为直观和便捷的图像编辑解决方案。

利用人工智能技术进行图片编辑,它能够通过先进的算法将两张图片无缝融合,创造出全新的视觉效果。这种技术通常被称为图像融合或图像合成,它可以在保持原有图片特征的同时,将两张图片的元素自然地结合在一起。

项目源地址:https://github.com/ali-vilab/MimicBrush

comfyUI版:https://github.com/AIFSH/ComfyUI-MimicBrush

一、需求人群:

"MimicBrush适合需要进行图像编辑但缺乏专业图像处理技能的用户,以及希望快速实现创意构思的设计师和艺术家。它通过简化编辑流程,使得用户可以更专注于创意表达,而不是技术细节。"

二、产品特色:

用户只需指定源图像中的编辑区域(即遮罩)

提供一张参考图像,展示编辑后期望的区域样式

模型自动捕捉源图像与参考图像之间的语义对应关系

通过一次执行完成编辑任务,无需复杂的参数调整

支持多样化的编辑结果,满足不同用户的需求

构建了基准测试,以促进进一步的研究和发展

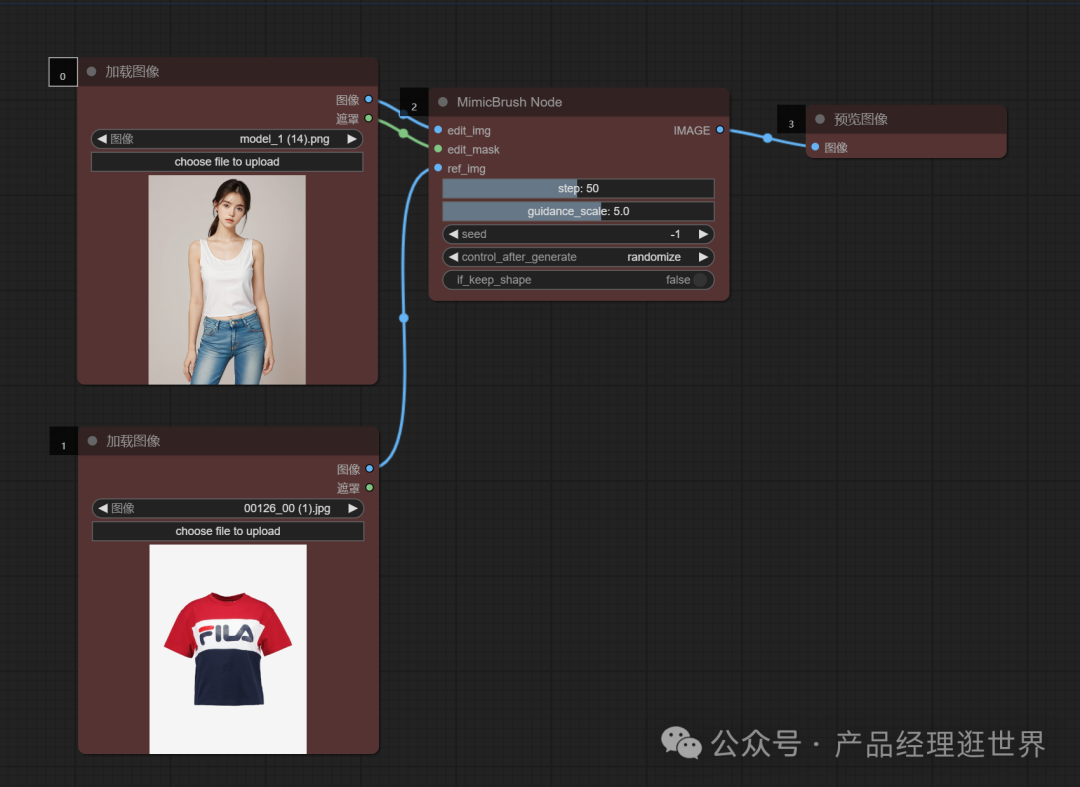

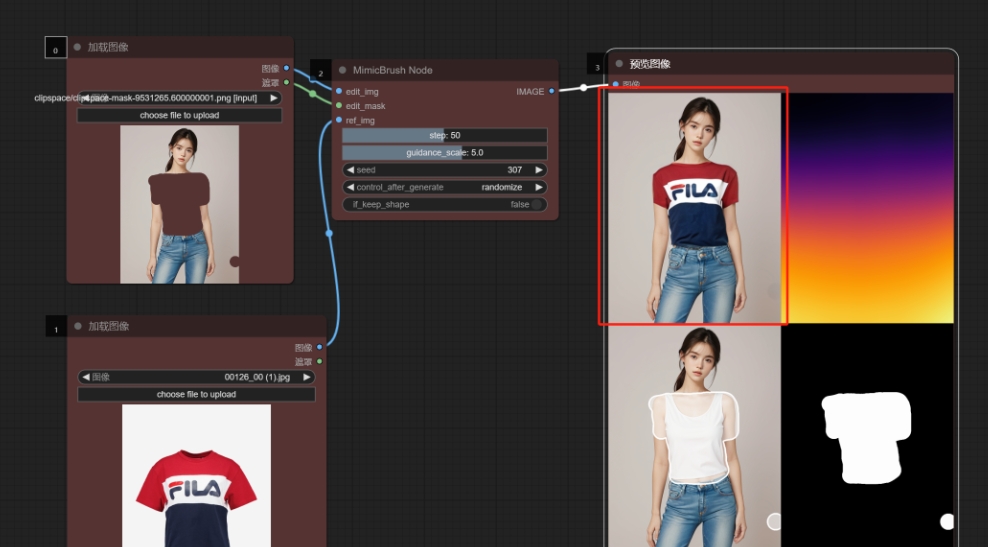

三、操作演示 这里我用comfyUI版来进行测试。

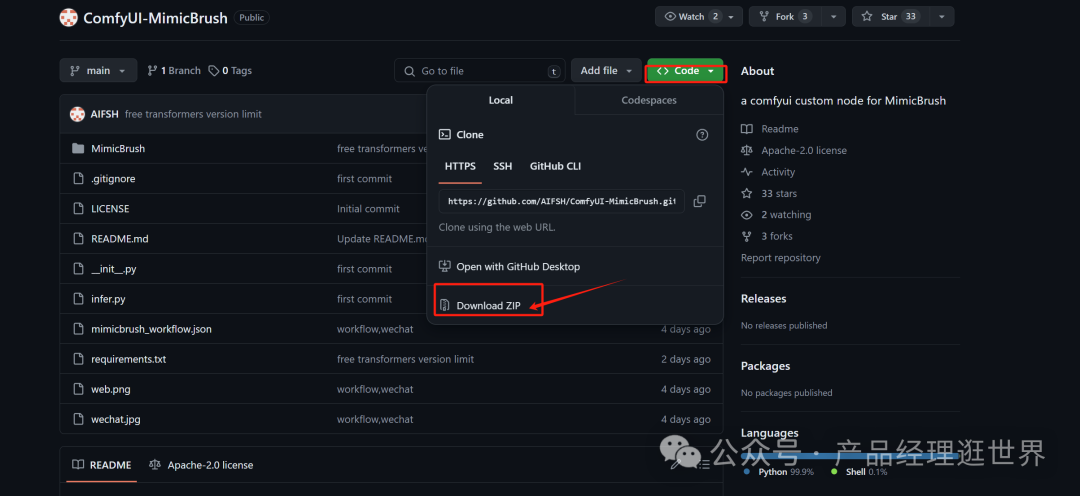

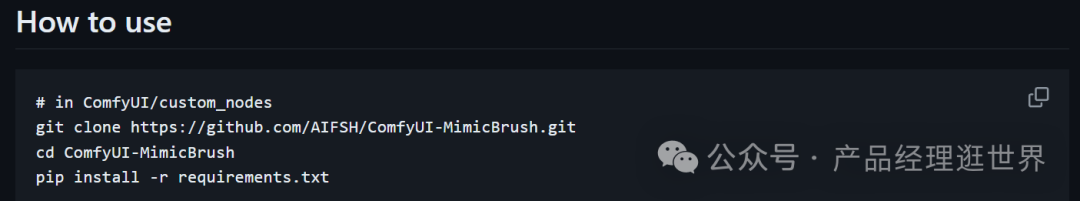

打开ComfyUI-MimicBrush网址。下载

解压复制进节点文件夹,

重启comfyUI,

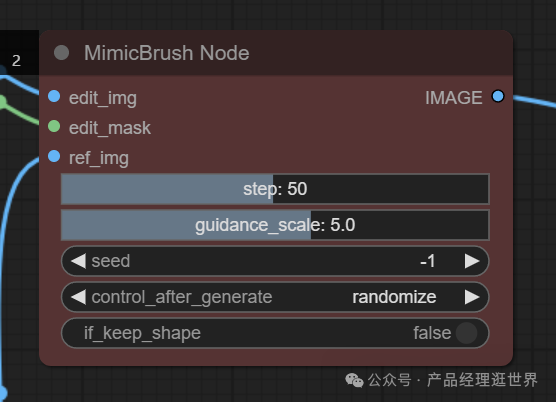

拖出节点,mimicbrush node

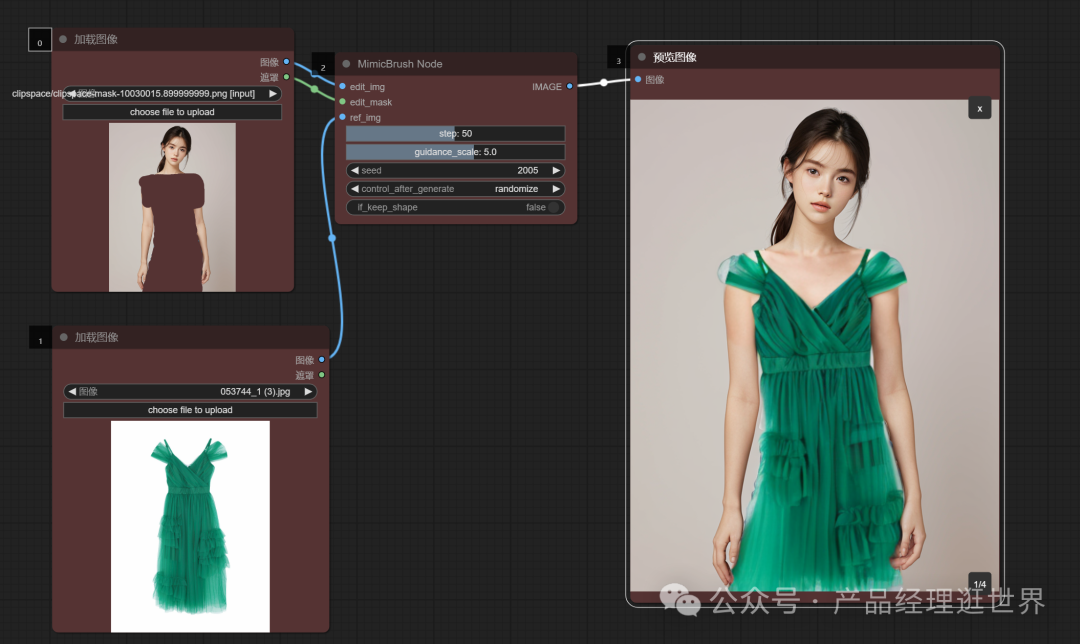

提供源图片与其蒙版和参考图,如下图示:

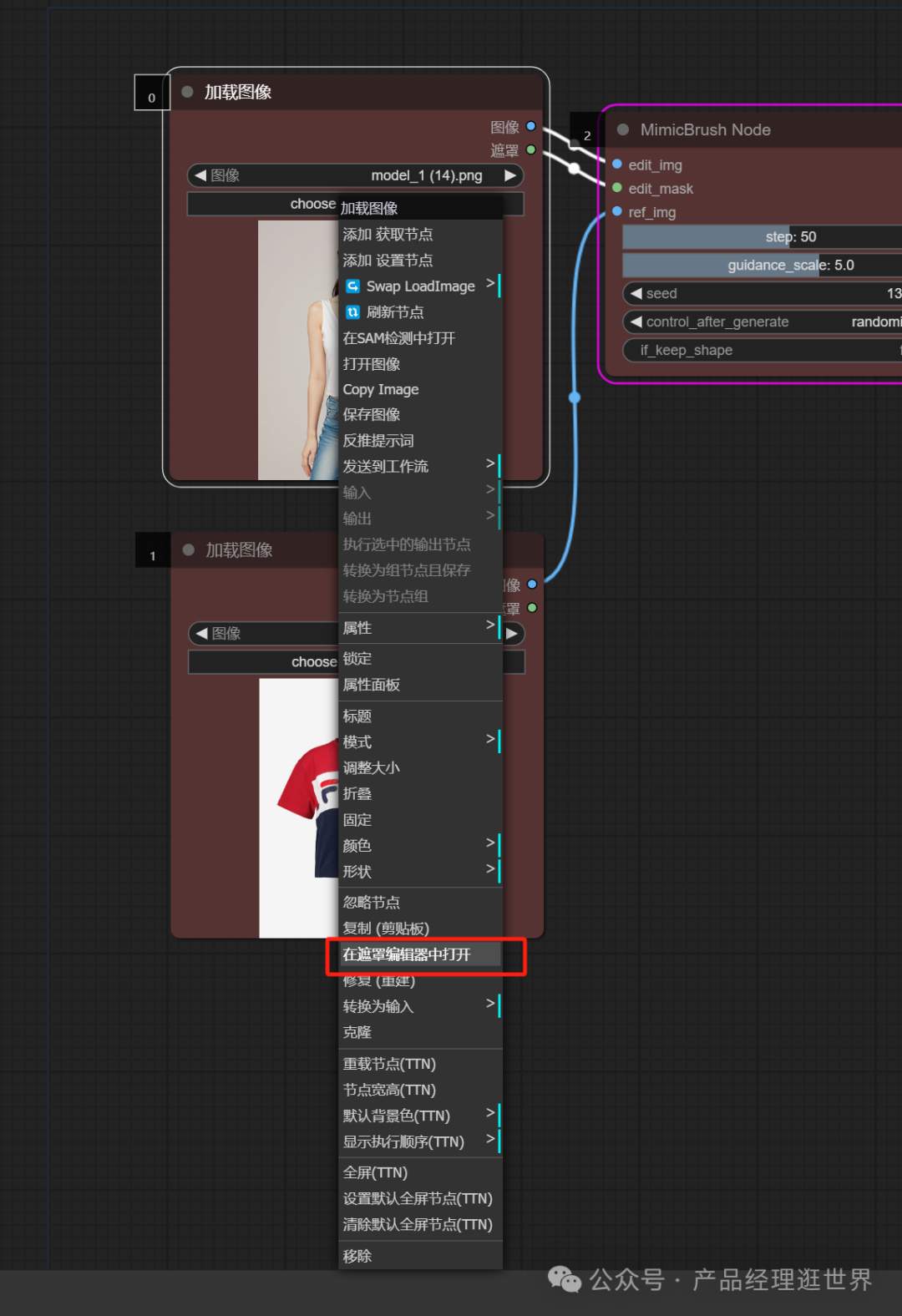

右键:编辑要修改的区域。

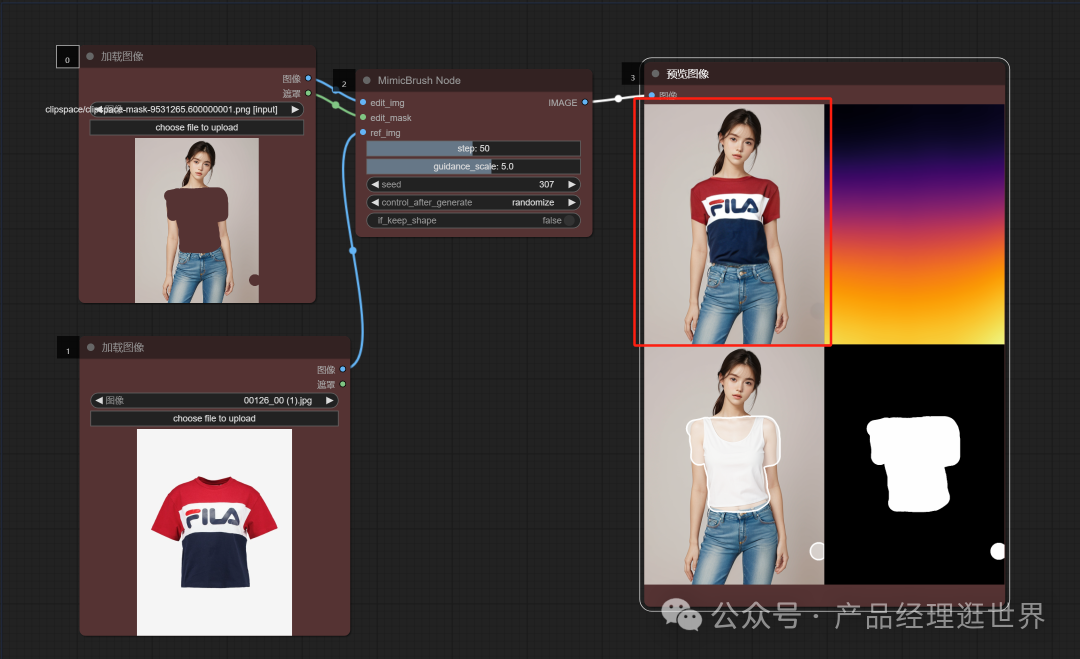

点击运行:

就这样我们得出换衣服后的结果,我感觉很不错,能很好保留了衣服细节。

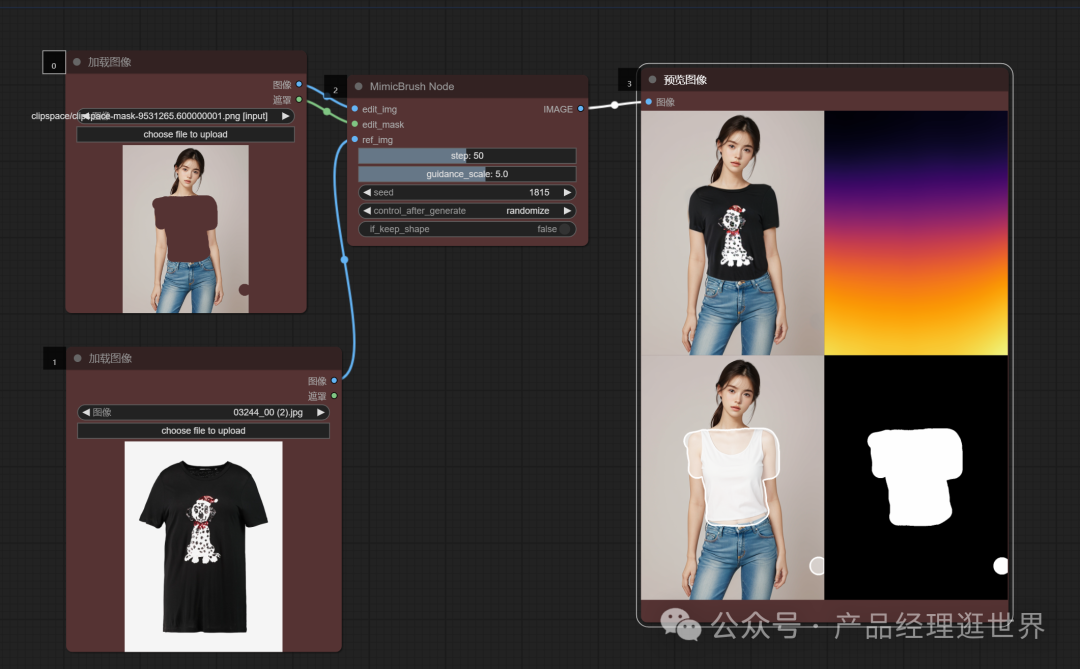

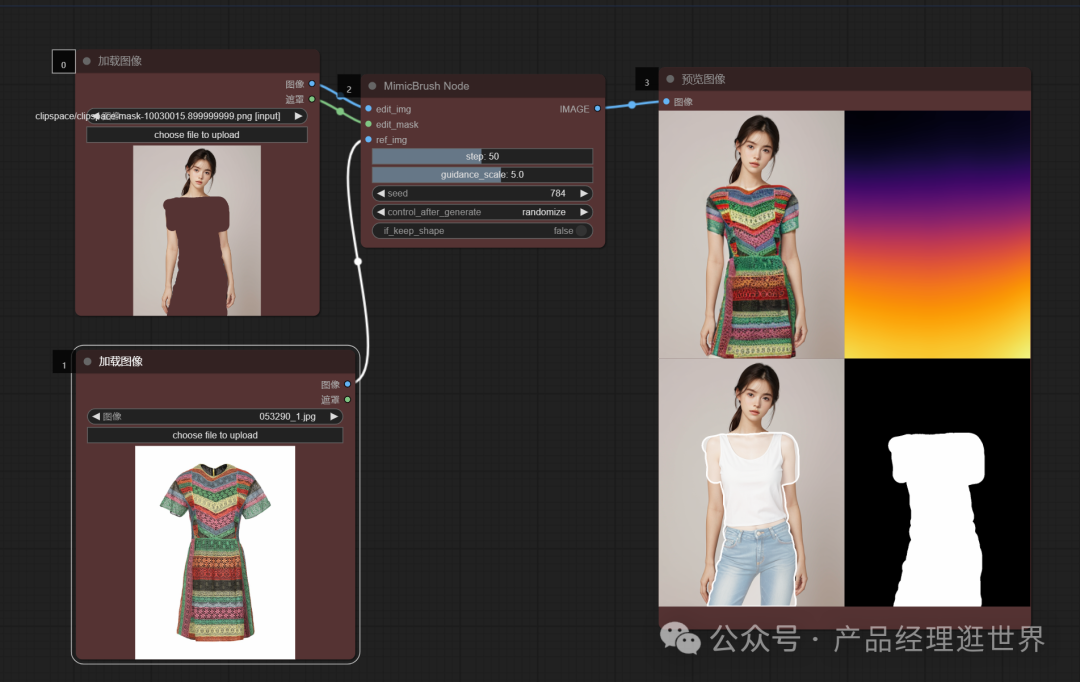

再换几个试试:

非常不错。换衣必备节点啊。

再扩大区域,试下裙子。

可以可以,我只是随意画的蒙版,我觉得通过自动识别把衣服区域形成蒙版,能更好地更换衣服。后面我将运用它搞一个换衣工作流给大家介绍下。

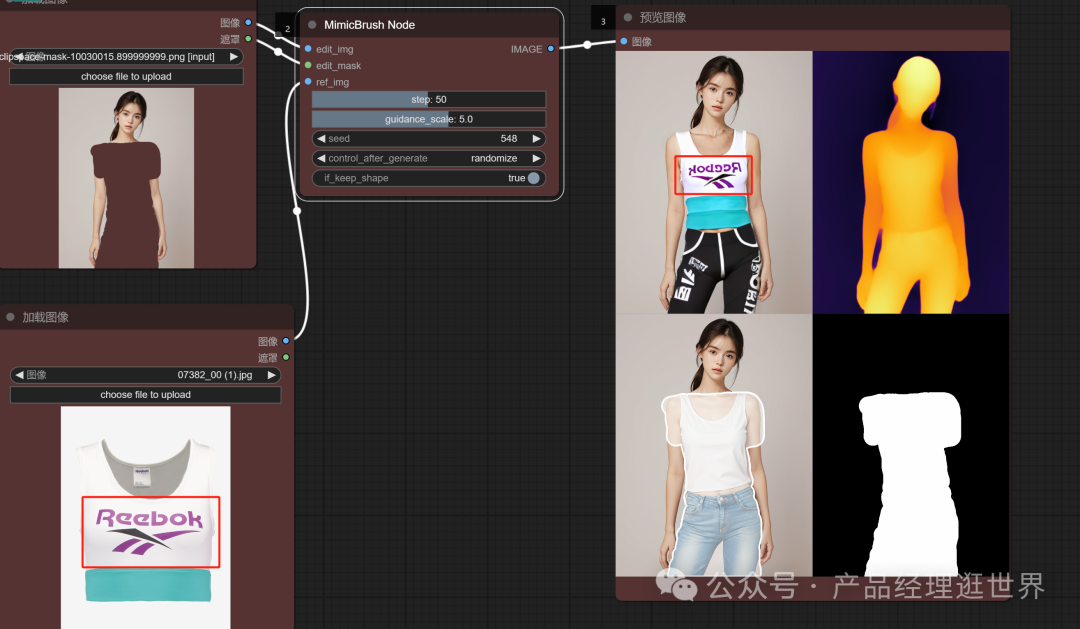

偶尔会出点小差错,上面的结果,镜像了。多抽卡即可。

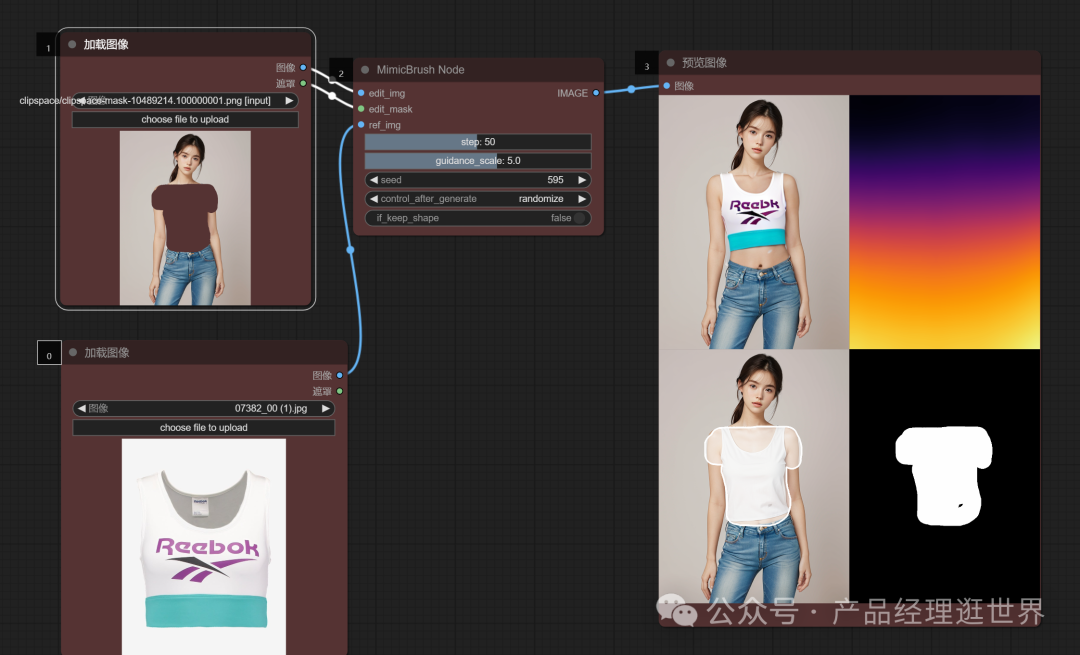

区域的变化跟参考图是有联系的,会影响生图结果。下图我是重新绘制上半身,所以它生图结果又正常了。的确不错这个项目。

感受:能很好的保留参考图的细节,甚至不用写提示词能自动判断出我需要什么。比之前使用的换衣节点好点。相信后面优化后能兼容更多条件加入一起生图。

以上就是教程的所有内容

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)