更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

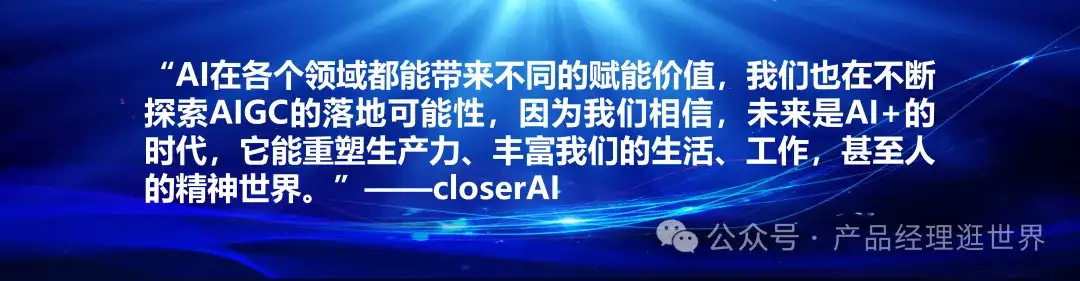

【closerAI ComfyUI】效果太逆天了!万相wan2.1深度控制LoRA,实现风格转绘和高清修自由,AI微短剧必备!

大家好,我是Jimmy。前一期我们讲到通义万相wan2.1视频生成模型的控制lora,因为它增强了控制能力,所以他直接提升了这个模型的可玩性,还有创作的想象力。

前一期已经将万相控制Lora的下载方式以及工作流使用作了说明 ,没看的小伙伴可以先看了,再看这期哦。

【closerAI ComfyUI】开源AI视频要起飞!万相生态控制LORA加持下,让wan2.1可玩性更高!下一个导演就是你!

这期主要演示一些案例,让我们一起感受转绘视频的能力,以让我们在AI微短剧创作上思考考如何去应用。

首先,打开我们closerAI 优化后的工作流,这个工作流是基于前期发布的LORA控制工作流,增加了tile控制。

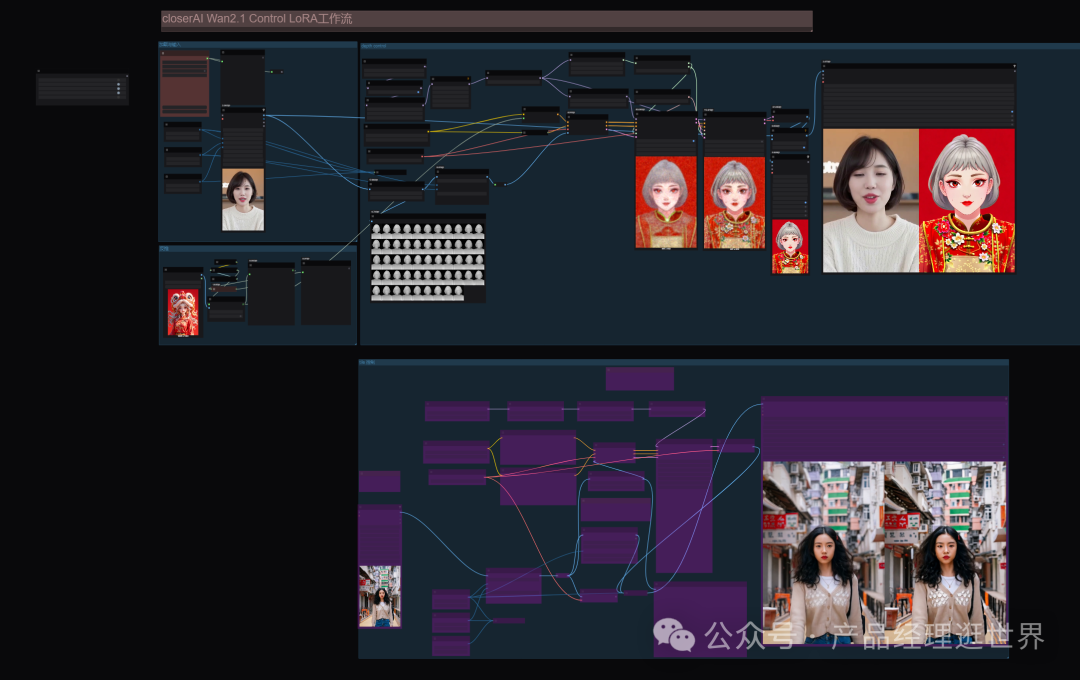

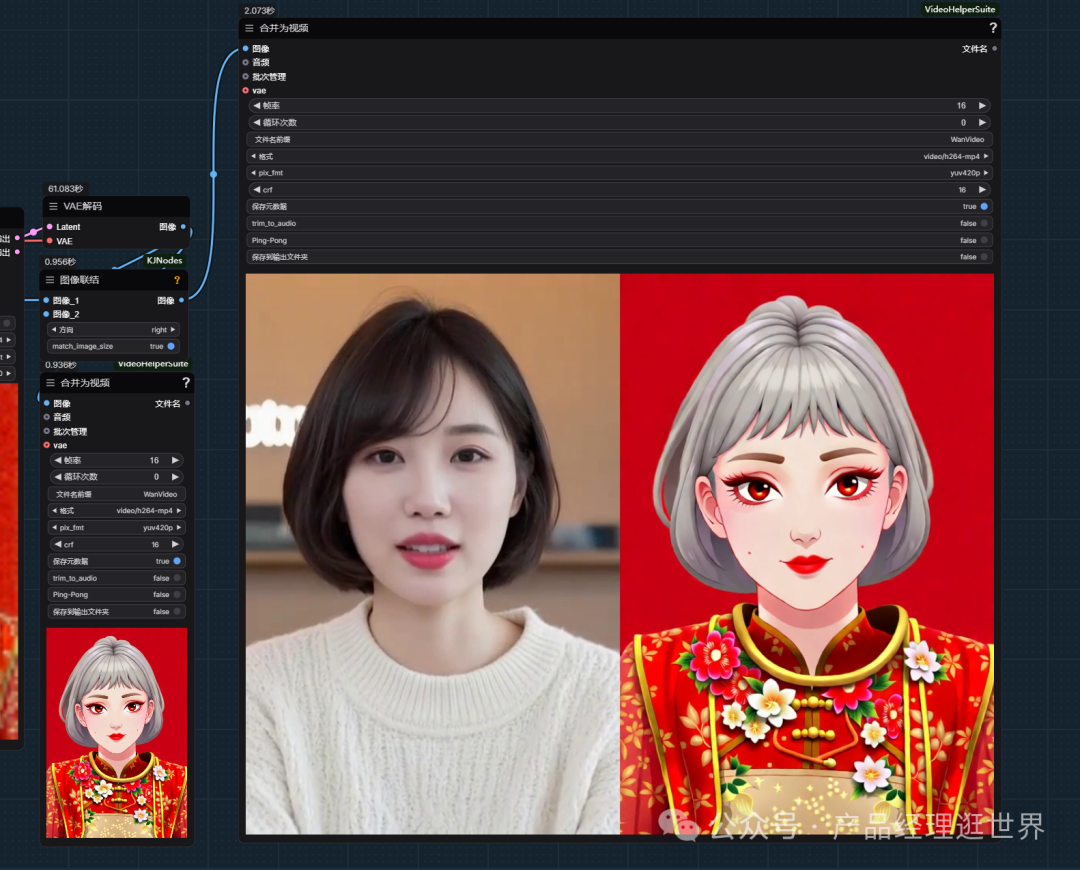

先在工作流的加载与输入区,输入一段参考视频,提示词写一个美女在讲话,设置下它的尺寸与帧数。

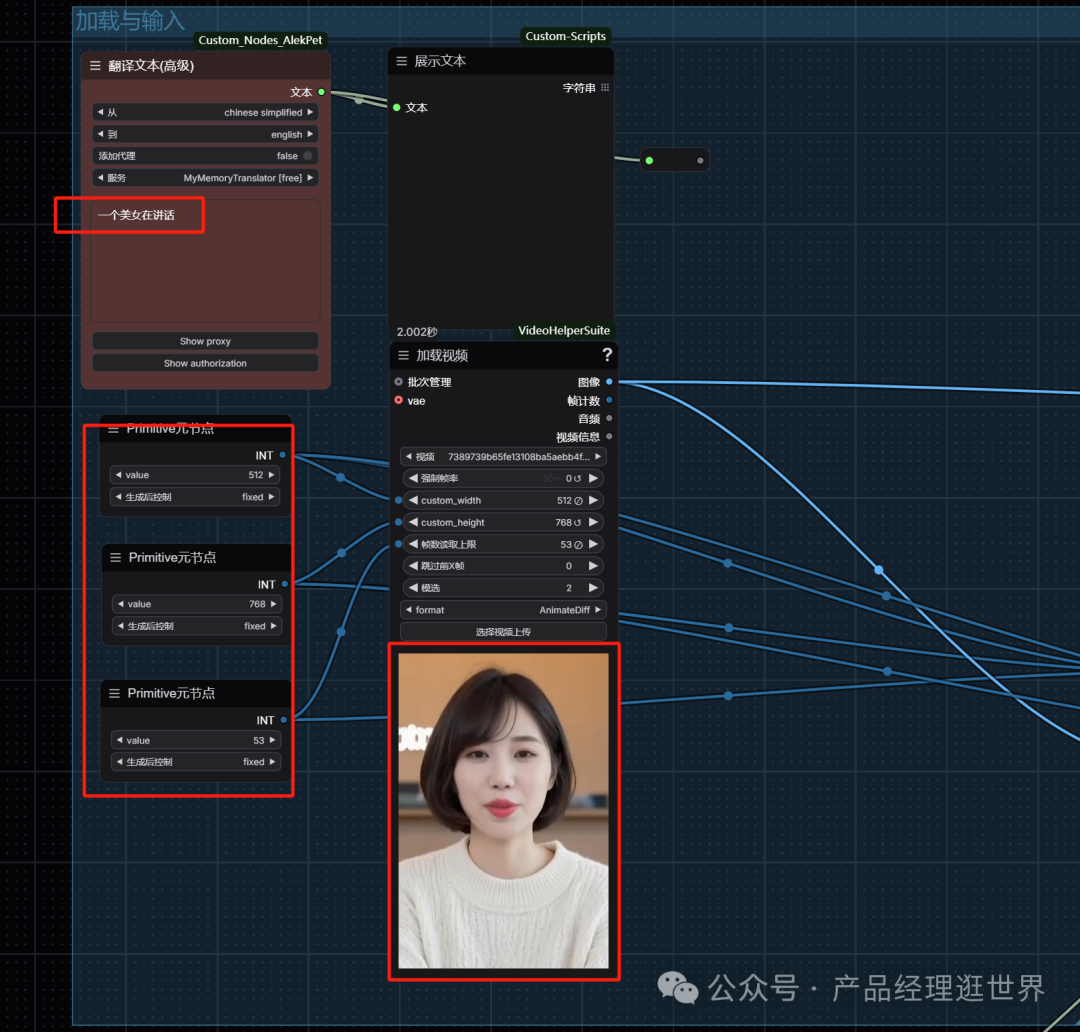

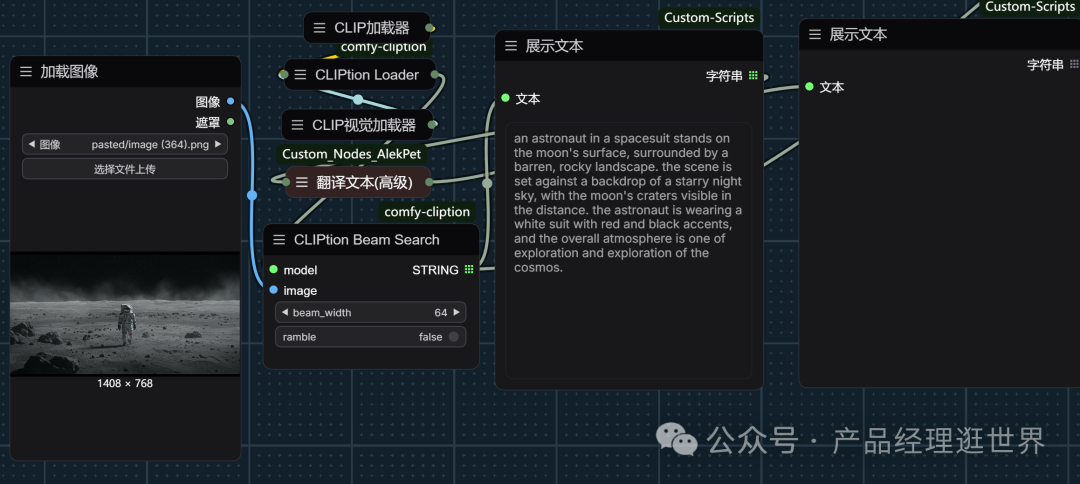

加载一张参考的风格图,经过cliption进行反推。

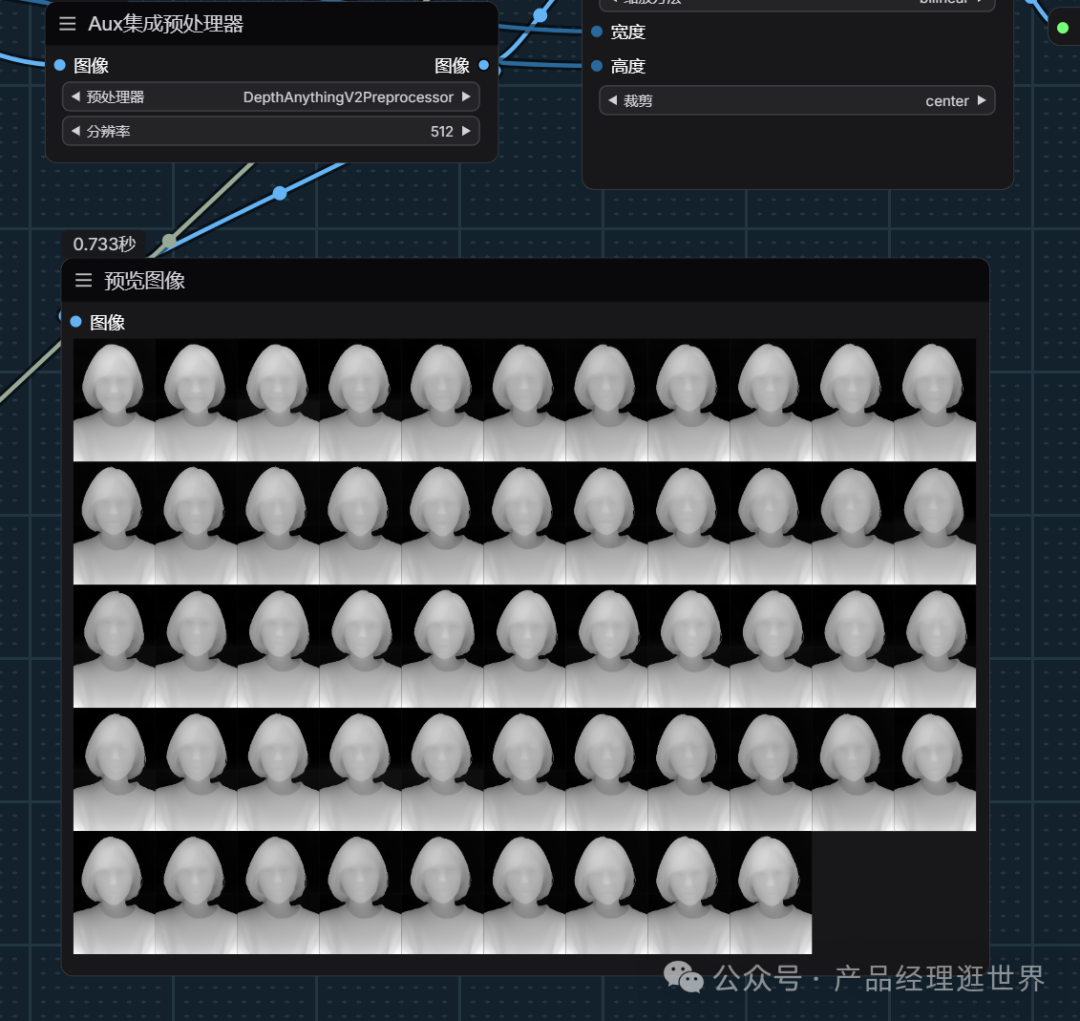

通过深度预处理:

进入主体转绘工作流中:

生成结果如下:

可见,通过参考图像,就能轻松高效地输出转绘后的视频。而且相对稳定。

我们再试下其它风格:

加载一张宇航员的图,

加载一个视频动作参考,提示词写向前走动。

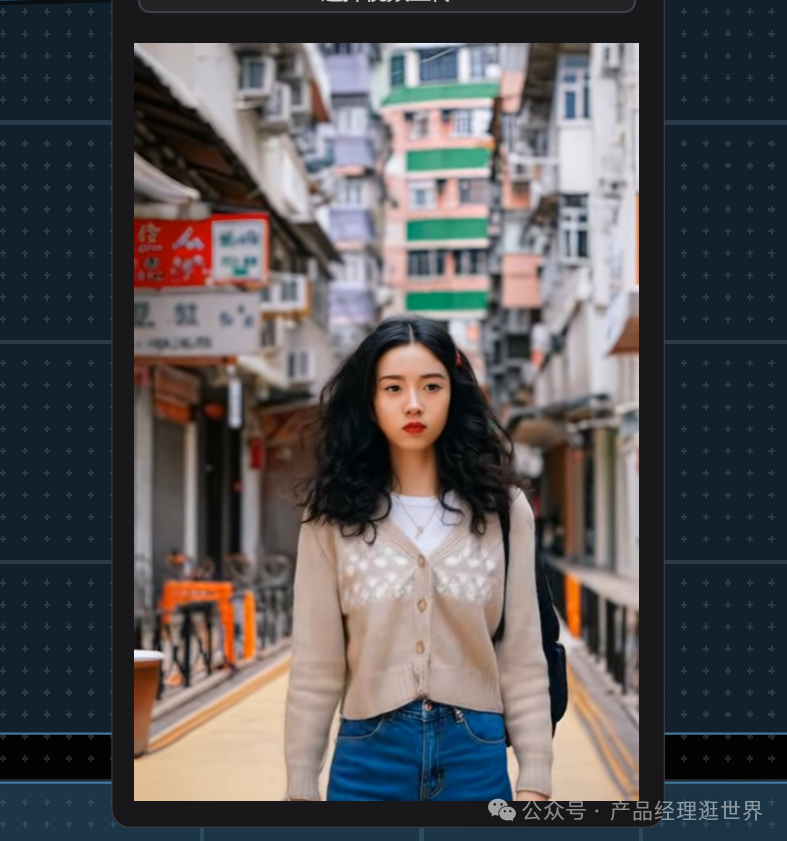

转绘后的结果如下:

我们再试下其它的

效果太棒了,

思考:

这让我们思路一下子打开了,通过找视频动作以及风格的参考,就能生产一些场景的分镜头内容。但是缺点可能就是场景、人物致性问题了。不知道大家有没有发现最后两个案例,我将参考视频的人物先进行了人脸、服饰的一致性处理。在经过转绘后,人物的大致形象有一定的保持。这也是在使用过程中总结的一些小经验分享给大家。

至于更加完美的人物场景一致性的一个解决方案。这得看后面wan生态的完善程度了,现在仅仅是深度控制的结果,就已经让我们感觉到它的无限的潜能,相信“让子弹再飞一会儿”,一定会有更好的一个解决方案。

以上是closerAI团队制作的stable diffusion comfyUI closerAI开发的closerAI 万相controlnet depth+tile 介绍,大家可以根据工作流思路进行尝试搭建。

当然,也可以在我们closerAI会员站上获取对应的工作流(查看原文)。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)