更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

【closerAI ComfyUI】FLUX生态进入秒出时代!最强加速器nunchaku实测:秒级出图+显存狂降3倍!已成生产力工具。

大家好,我是Jimmy。这期介绍一个爆炸的项目,FLUX模型我们都知道很吃显存,单单运行它文生图、图生图加上一些加速优化后像我8G显卡基本要1.5~2分钟左右,这还是没加LORA、fill、redux以及其它控制的情况下。如下加上控制,需要的时间就更久。虽然整理生图质量比其它模型好,但生成时间长是它的痛点。虽然有加速的方案,像teacha、sagettention等。但离作为生产力工具,在效率上还是有些欠缺。

现在,已经出现了一个新技术方向,4位扩散模型推理引擎nunchaku。最近推出0.2版本,已经将FLUX推进到秒级间输出的速度,并且生图质量与原生模型相差无几。

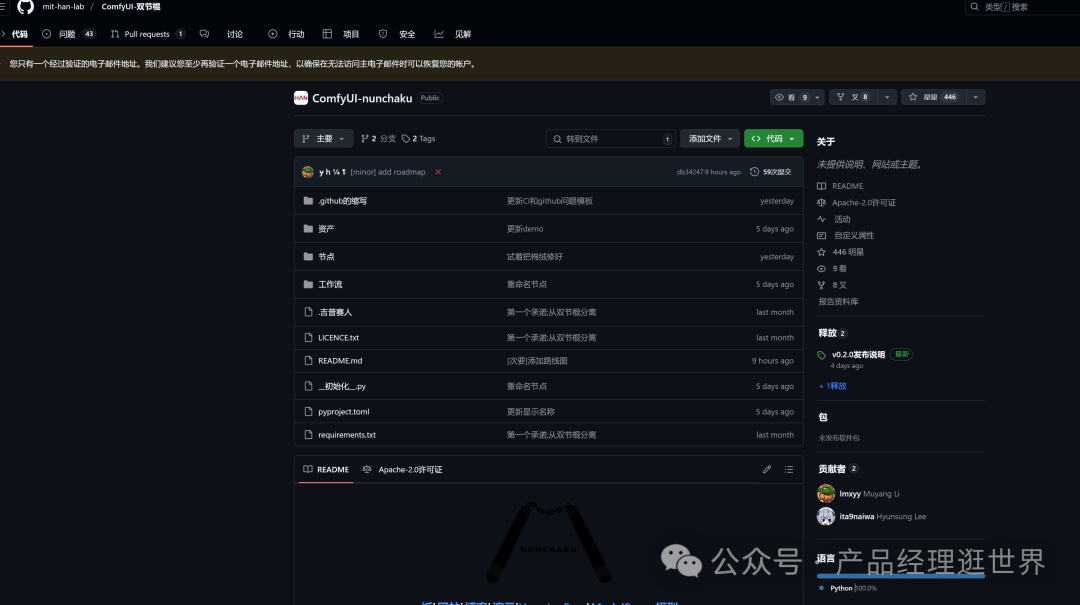

comfyUI-nunchaku介绍

nunchaku是由MIT Han Lab研发的4位扩散模型推理引擎,专为优化Stable Diffusion、Flux等生成式AI模型设计。其核心技术突破包括:

- SVDQuant量化技术。通过低秩分解(Singular Value Decomposition)和核融合(Kernel Fusion),将模型权重与激活值压缩至4位,显存占用减少3.6倍(如16GB显存可运行原需50GB的Flux.1-dev模型)。解决传统4位量化图像模糊问题,LPIPS质量指标仅0.326(接近原版0.573),肉眼无差异。

- 多模态生态兼容。完美支持Flux模型、LoRA、ControlNet及多显卡架构(NVIDIA Ampere/Ada/A100)。文生图、ControlNet重绘、修复等,速度提升8.7倍。

- 硬件级优化。针对NVIDIA CUDA架构优化,支持FP16/FP8混合精度计算,16G显卡实现3秒生成(原版需111秒)

comfyui节点:https://github.com/mit-han-lab/ComfyUI-nunchaku

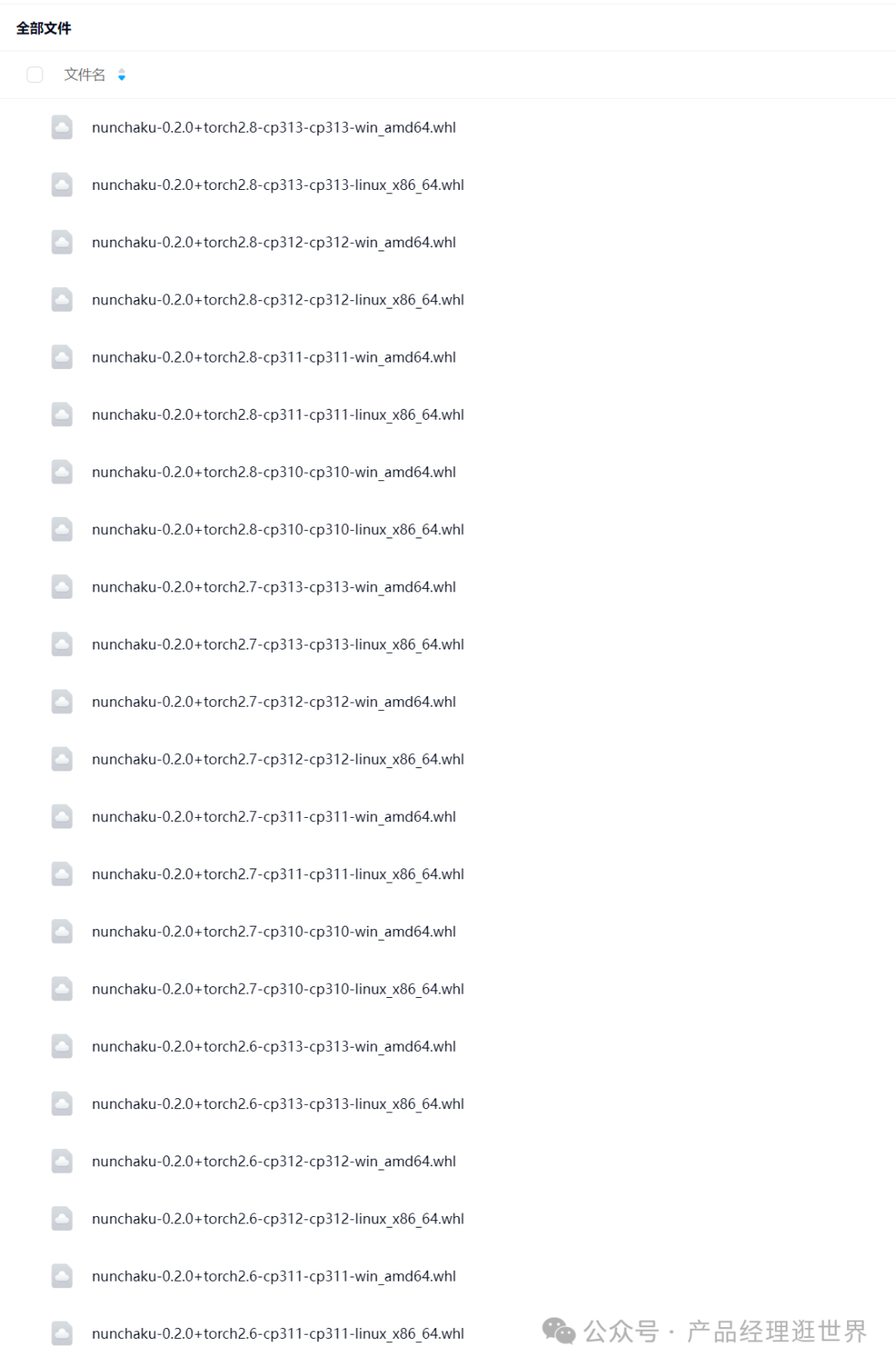

轮子地址:https://huggingface.co/mit-han-lab/nunchaku/tree/main

4月5日发布 v0.2.0!此版本引入了多LoRA和ControlNet支持,并使用FP 16 attention和First-Block Cache增强了性能。还为FLUX.1-redux添加了20系列GPU兼容性。

安装方面

1、下载节点,放置comfyUI/custom_nodes下。

2、安装轮子。上面地址。直接PIP安装。切记要pytorch2.5以上版本,版本不够,升级就行,但注意要提前备份pyton包。以防万一。轮子下载跟自己版本一致的。

3、下载模型。模型放置comfyUI/models/unet下

重启comfyUI

体验与优化方案

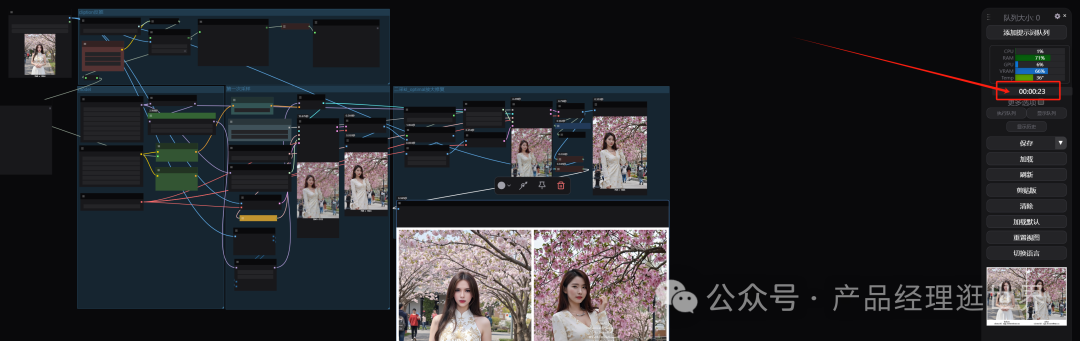

它的节点包中有工作流,但如果直接使用它的工作流生图,生图的质量会不稳定,你会感觉还是相对差那么一点的。同时它加载模型是需要一定时间,相对是在可接受的时间范围内,模型加载后再抽卡或者修改参数后生图,生图就快到飞起。

我用优化后的工作流跑了23秒出图。

它的工作流没什么好说的,较FLUX出图快4倍,质量相差无几。但因为做了加速同时是4位量化后模型,损失不大,但还是有损失。这里主要讲讲我们使用它的一些优化思路心得。仅供大家参考 。

前面我们推文介绍了FLUX的放大修复方案:

【closerAI ComfyUI】强大!放大修复新思路!效率与质量并存的神器!FLUX生图必备的高清放大方案,必须学习起来

重点来了:利用调度器kl_optimal高清修复思路与nunchaku相结合使用。

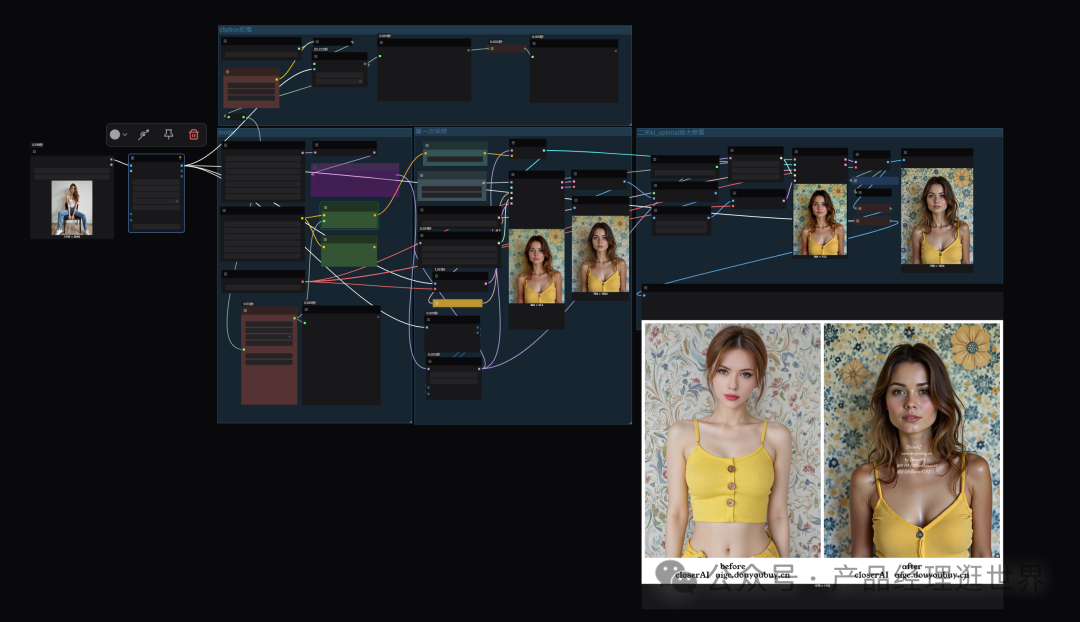

我们closerAI基于此搭建了一个FLUX nunchaku超级加速生图工作流,如下图示:

以上是未进行一些放大以及LORA结合的生图,仅是基于原图尺寸及参考其风格进行生图。

我们工作流思路如下:

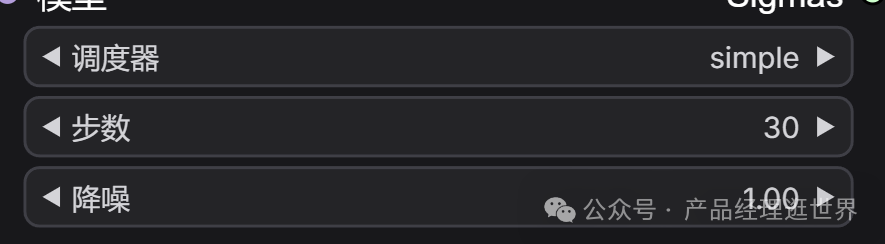

1、nunchaku FLUX基础的文生图工作流作为第一次采样生图。

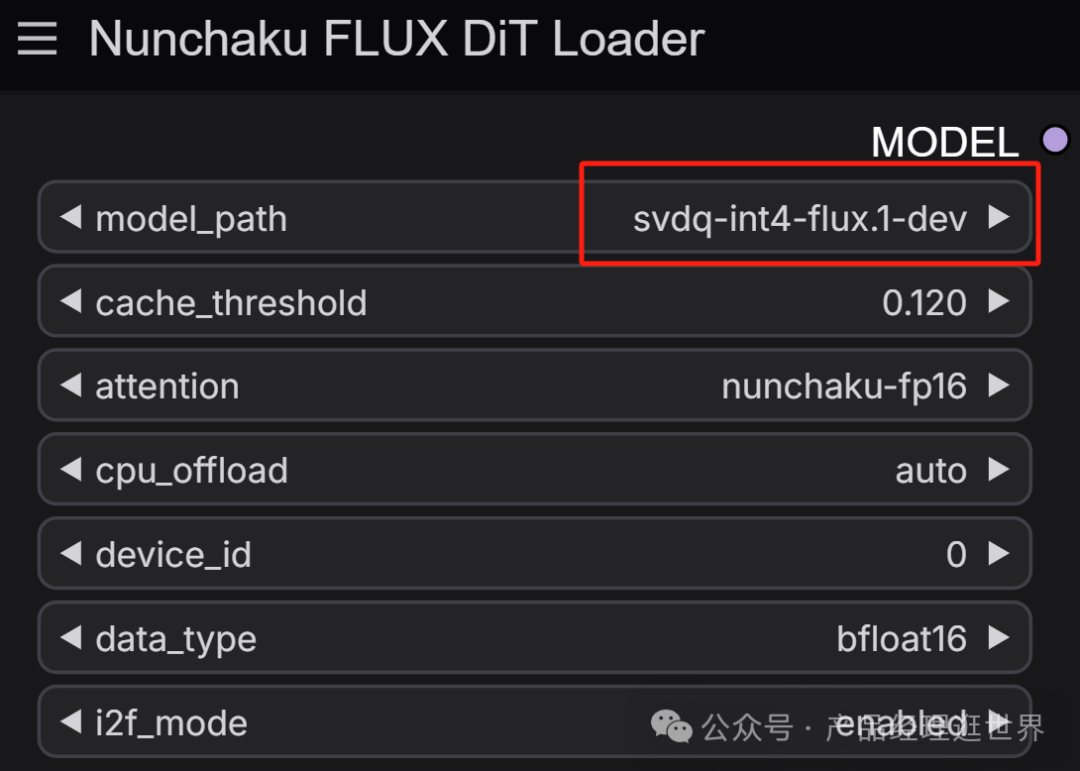

这里使用它SVDQ-int4-flux.1-dev模型,其它参考设置如下图:

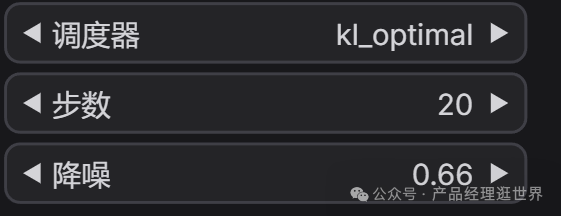

2、接入kl_optimal二次采样生图。

本地算力不够怎么办?

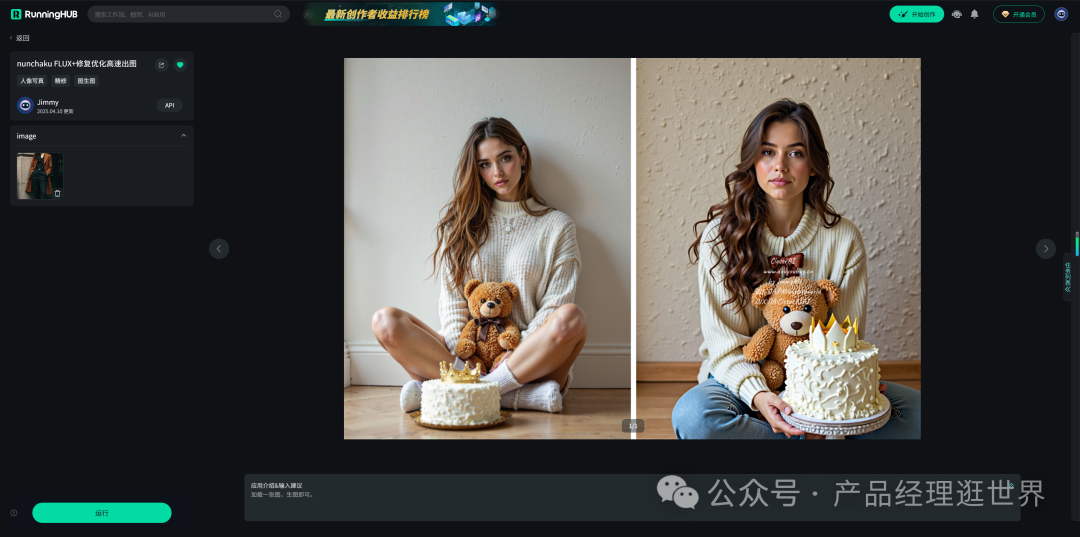

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

runninghub.cn nunchaku FLUX工作流体验地址:

https://www.runninghub.cn/ai-detail/1910201953526448130

注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151

通过这个链接第一次注册送1000点,每日登录送100点

最后几句:

nunchaku FLUX优点,超高速生图,解决了FLUX的生图速度慢的痛点。同时它的生态也逐渐完善,支持了FLUX的fill\redux\controlnet\多LORA等。在一定程度上是可以替代FLUX进行生图使用的。比较推荐大家使用。作为生产力,生产底图是完全够用的。

以上是closerAI团队制作的stable diffusion comfyUI closerAI开发的FLUX nunchaku超级加速生图工作流介绍,大家可以根据工作流思路进行尝试搭建。

当然,也可以在我们closerAI会员站上获取对应的工作流(查看原文)。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)