更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

【closerAI ComfyUI】显存救星!300多M的LORA带来10倍加速!wan2.1-VACE大统一模型的加速器!冲!

大家好,我是Jimmy。5月14日阿里通义万相开源了VACE大统一的视频生成与编辑模型:

震撼开源!开源界福音!通义万相 Wan2.1-VACE 正式开源!集视频生成与编辑大统一模型!能力强大效果炸天!

模型能力的升级使它能满足多种视频处理的任务。但是能力越强,对显存的要求越高。4090 24G也要跑个大几十分钟,时间效率虽对比以往传统的视频拍摄有质的飞跃,但是以前传统的制作流程不用抽卡,用AI视频生成或者编辑无法一次就得出好的结果,需要不断的抽卡直到满意,在控制力与精准理解上还是有一段路要走。

那是没有办法快乐地抽卡了吗?这几天开源社区中已有大神制作出加速LORA:Wan21_CausVid_14B_T2V_lora_rank32

号称拥有10倍的加速,但是我们都知道,加速都是跳过步数,是以牺牲质量为代价的加速生成,用wan2.1-VACE 14B的模型进行生成会出1.3B的效果。

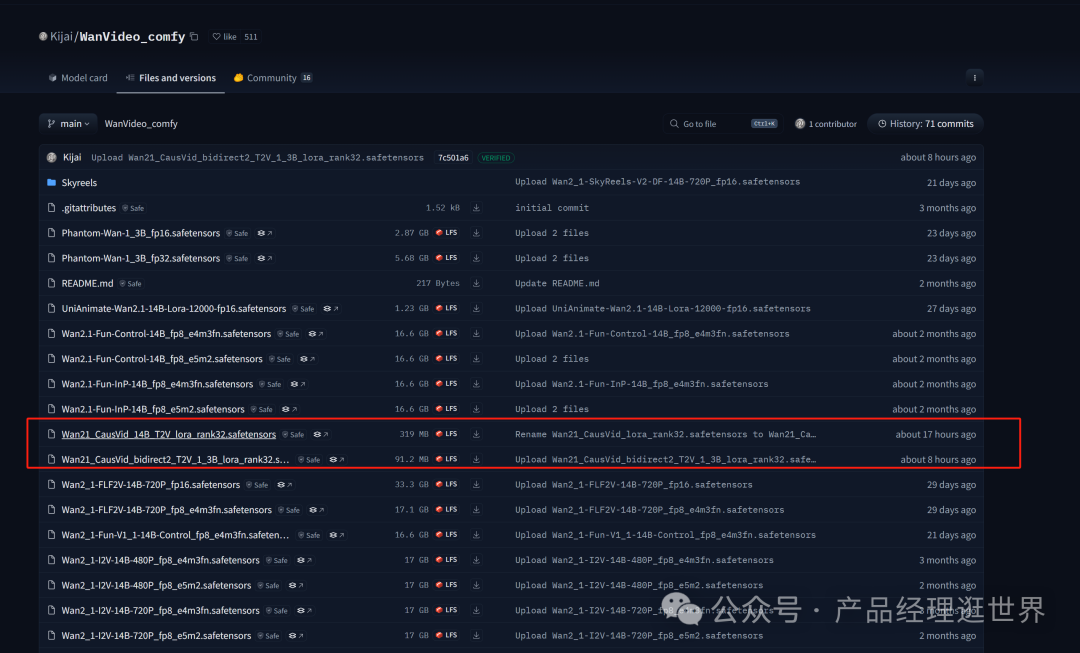

目前KJ大佬已在其抱脸项目中更新了并支持了这个LORA。我们可以在以下链接中下载:https://hf-mirror.com/Kijai/WanVideo_comfy/tree/main

下载后放置models/loras中即可

使用方法:

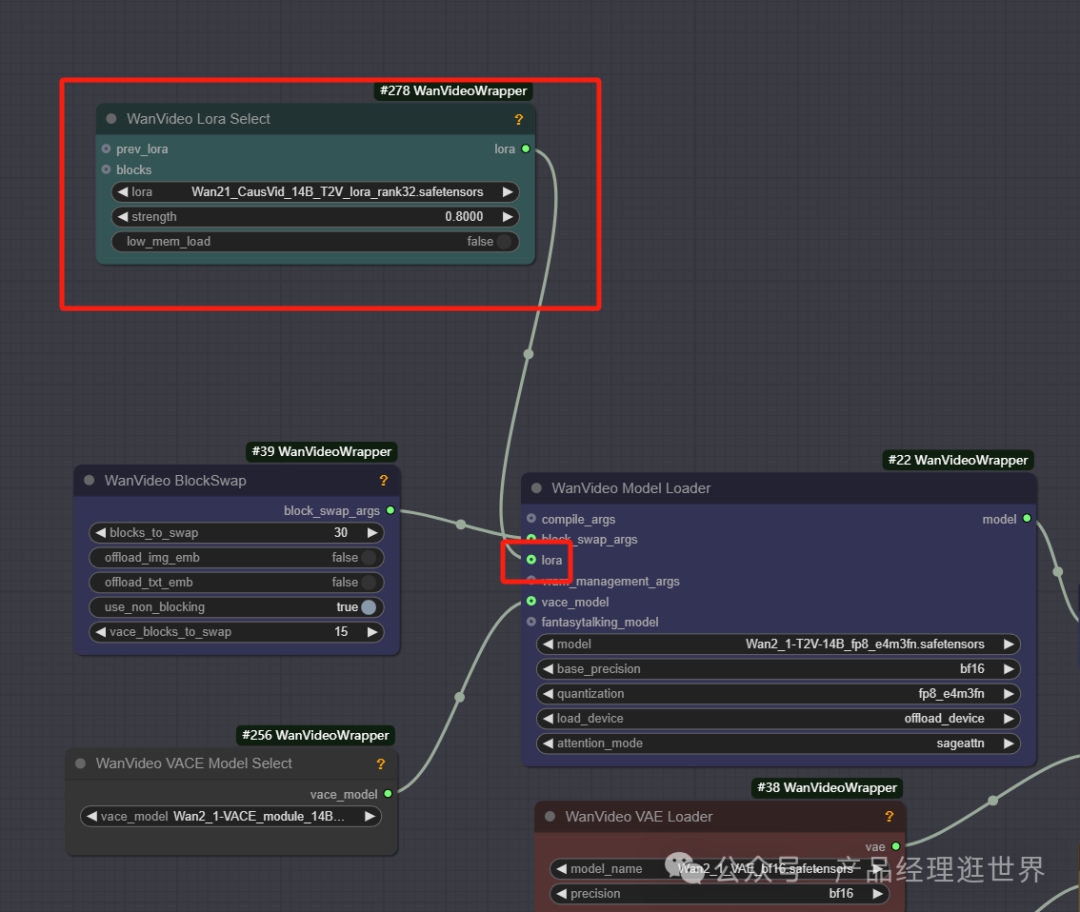

更新KJ节点后,在工作流中加载模型时,在wanvedio model loader中拉出lora节点,并选中我们下载好的causVid 14B lora. 强度设置区间为:0.5~0.8

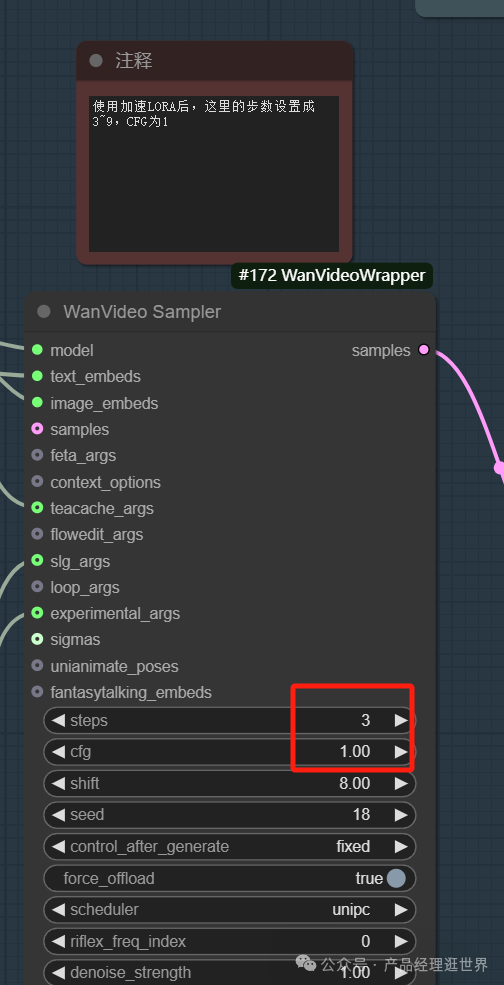

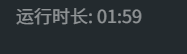

同时,在采样节点中,将步数设置成3~9之间,CFG设置成1。如下图示:

然后执行即可。

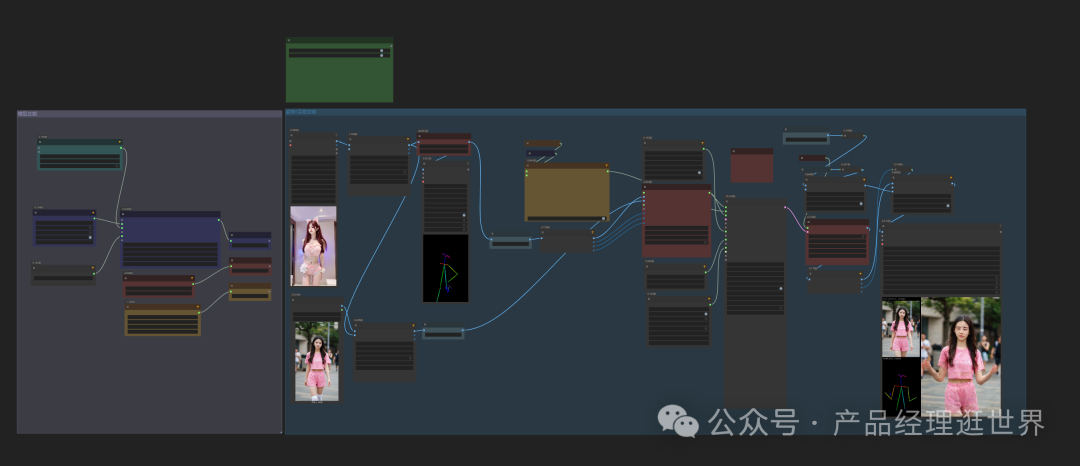

我们用姿势控制视频生成工作流测试下:

不加这个加速LORA时,跑出来的视频是这样的,我们跟后面加了LORA之后进行对比:

下是添加了加速LORA跑的

我是这在RH上跑的。时长2分钟。

其中采样节点一共15秒多。

但质量嘛:我截个图算了,生成的视频就不放上来了。

可能步数太低,尝试改为9跑下,上面说到的值就不变:

4分钟,视频如下:

我们看到,质量上虽有点出入,但基本是没问题,是可以接受的一个结果。速度上4分钟。

在其它参考不变的情况下,步数是生成质量的关键。上面的测试我测试了步数为3和9时的结果。

所以步数为3时,2分钟,步数为9时,4分钟。所以添加加速LORA,在强度为0.8时,它的的生成时间是2~4分钟。大概是这样的时间效率了。我们这个时候大概就有个心理预期了,根据以上自行调整参考生成。

本地算力不够怎么办?

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

runninghub.cn真人转3D模型工作流体验地址:

https://www.runninghub.cn/ai-detail/1923203802458222593

注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151

通过这个链接第一次注册送1000点,每日登录送100点

最后几句:

以上是基于wan2.1-VACE视频生成的10倍加速LORA:Wan21_CausVid_14B_T2V_lora_rank32的介绍与使用方法,以及closerAI团队制作的stable diffusion comfyUI closerAI搭建的closerAI VACE姿势控制视频生成工作流介绍,大家可以根据工作流思路进行尝试搭建。

当然,也可以在我们closerAI会员站上获取对应的工作流(查看原文)。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)