更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

【closerAI ComfyUI】速度与质量并在!万相又一加速器AccVideo:加速视频扩散模型,赋能万相全生态视频生成!爽!

大家好,我是Jimmy。之前有介绍万相VACE的加速器LORA——causvid

【closerAI ComfyUI】显存救星!300多M的LORA带来10倍加速!wan2.1-VACE大统一模型的加速器!冲!

的确它的速度非常快,通过参数的调整,能让视频生成找到一个折中的既快又保质的结果。今天同样介绍一个视频加速扩散模型:Accvideo。

AccVideo:基于合成数据集的加速视频扩散模型

项目链接:

AccVideo是一种新的有效的提取方法,用于加速合成数据集的视频扩散模型。

介绍很简单,它分别对万相视频模型和混元视频模型做了加速模型。

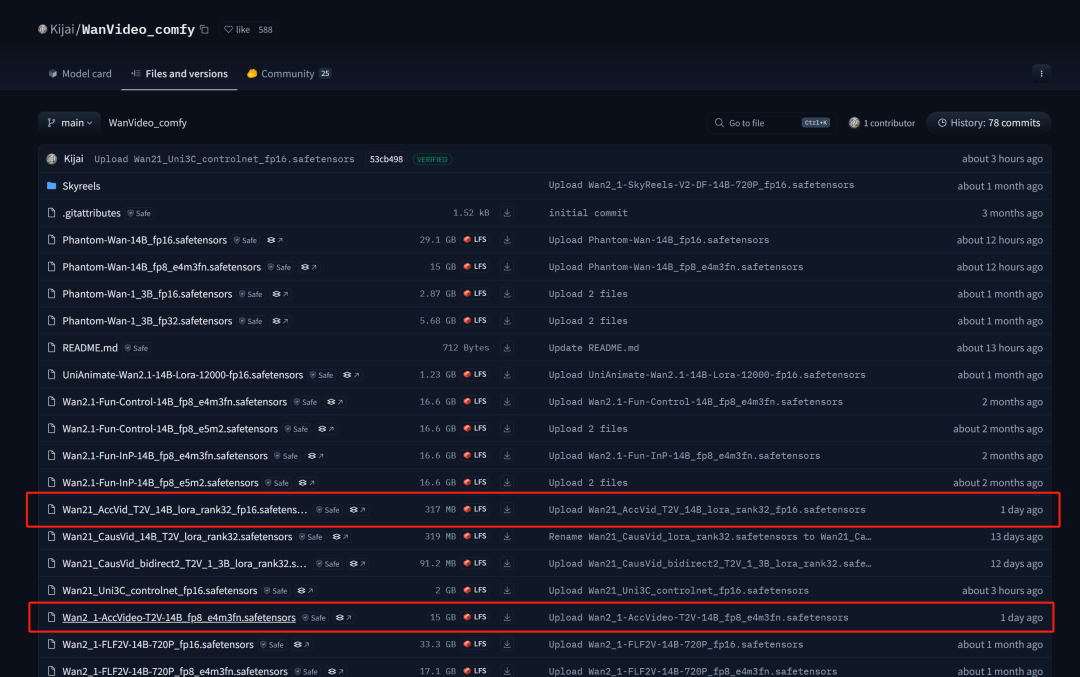

但如果直接下载它的原模型是不能使用的。KJ大佬已将其量化,在KJ大佬的抱脸中我们能找下下载的链接:

有两个一个是底模,一个是LORA。底模版本需放置在models/diffusion_models文件夹,Lora版放置在models/loras文件夹。它的使用方法是分别使用的,而且效果是差不多。所以,对于我们而言。直接选择LORA即可。

下载Wan21_AccVid_T2V_14B_lora_rank32_fp16.safetensors。

comfyUI中的实现与体验

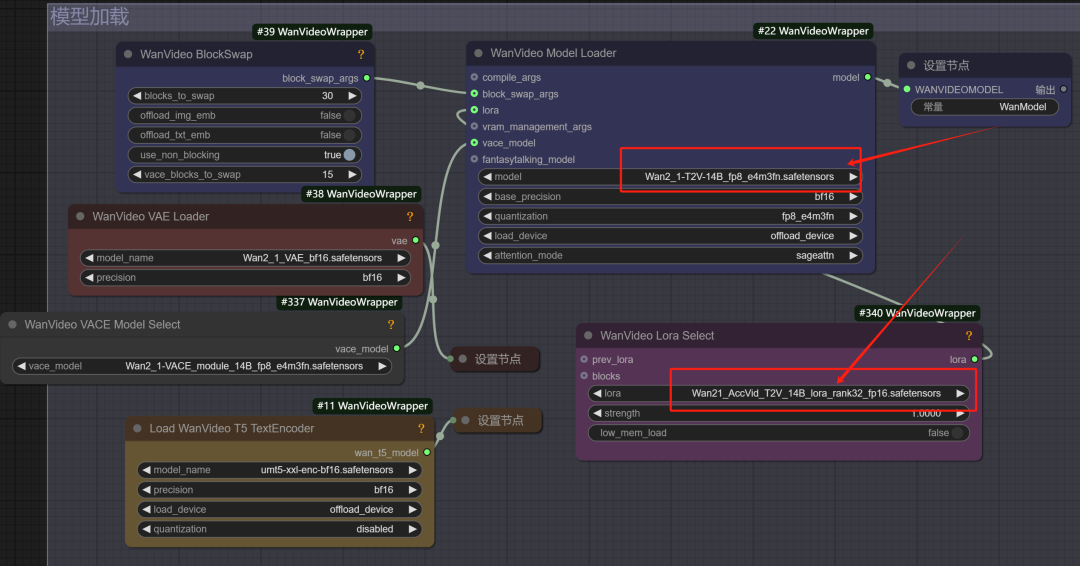

因为是KJ大佬的实现,所以我们更新KJ节点即可。因为是LORA,使用方法就是在wan2.1的文生图、图生图、VACE全生态工作流中加入LORA即可。

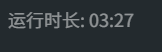

像如果是VACE,我们要用wan2.1的文生视频底模+VACE对应版本模型+ACCvid LORA。如下图示。

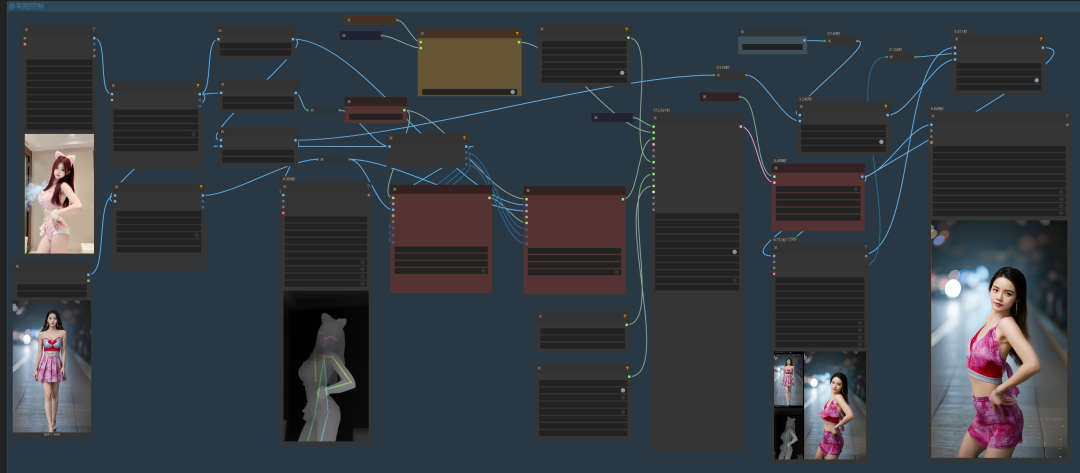

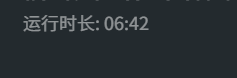

打开一个VACE的动作迁移工作流:

加载一个动作视频参考,再加载一个人物。执行:

视频我转成GIF了 ,下图示:

加载了ACCvid LORA的运行结果是3:27秒,这是在RH上跑的。

我们不开LORA,跑了6分42秒:

本地算力不够怎么办?

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

runninghub.cn ACCVID+VACE加速动作迁移体验地址:

https://www.runninghub.cn/ai-detail/1927536312331702273

注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151

通过这个链接第一次注册送1000点,每日登录送100点

最后几句:

视频加速生成,我们既要速度也要质量。目前关于wan2.1的视频加速的方法,我们已介绍了两种方法,都是LORA来实现。一个是Wan21_CausVid_14B_T2V_lora_rank32,一个是Wan21_AccVid_T2V_14B_lora_rank32_fp16.safetensors,方法都是基于KJ版的万相视频生成工作流加载对应LORA来执行,速度是肯定有的,效果质量上大家多调试尝试参考找到合适的使!

以上是AccVid加速视频扩散模型的介绍与使用方法以及测试体验。以及closerAI团队制作的stable diffusion comfyUI closerAI搭建的closerAI VACE+ACCvid全生态加速生成工作流介绍,大家可以根据工作流思路进行尝试搭建。

当然,也可以在我们closerAI会员站上获取对应的工作流(查看原文)。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

closerAI-一个深入探索前沿人工智能与AIGC领域的资讯平台

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)