更多AI前沿科技资讯,请关注我们:

【closerAI ComfyUI】它来了!qwen-image-edit图像编辑模型正式开源!网页版和GGUF版量化也来了!体验与comfyUI实现看这篇就够了!

大家好,我是Jimmy。阿里团队最近非常积极,首先感谢他们在开源上作的贡献,北京时间8月19日凌晨两点多,阿里开源了qwen-image-edit图像编辑模型。

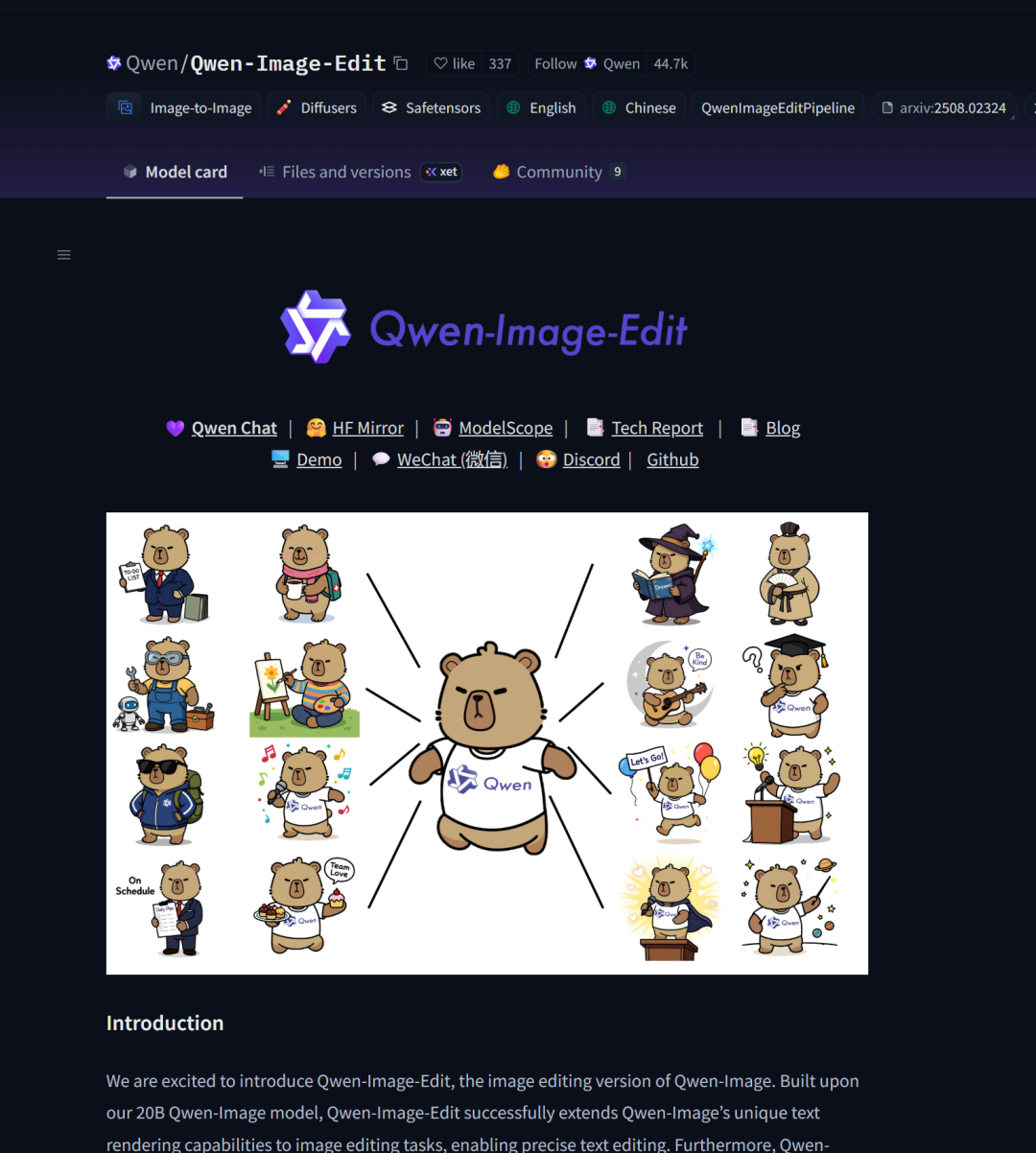

qwen-image-edit图像编辑介绍

作为 Qwen-Image 的衍生版本,该模型以 200 亿参数(20 B)的 Qwen-Image 模型为技术底座,不仅成功将 Qwen-Image 独有的文本渲染能力延伸至图像编辑场景,实现更精准的文本修改,还通过创新的双模型输入架构,解锁了语义与外观双重编辑功能,为图像编辑任务提供更全面的解决方案。

在技术架构上,Qwen-Image-Edit 采用协同优化设计:将输入图像同步传入 Qwen2.5-VL 模型与 VAE Encoder。其中,Qwen2.5-VL 负责视觉语义控制,确保编辑内容符合场景逻辑;VAE Encoder 则专注视觉外观控制,保障图像细节的真实感与一致性,二者结合让编辑效果既精准又自然。

Qwen-Image-Edit 三大核心特点

1. 语义与外观双重编辑,兼顾细节与整体

Qwen-Image-Edit 打破传统编辑工具的功能局限,同时支持两类核心编辑需求:

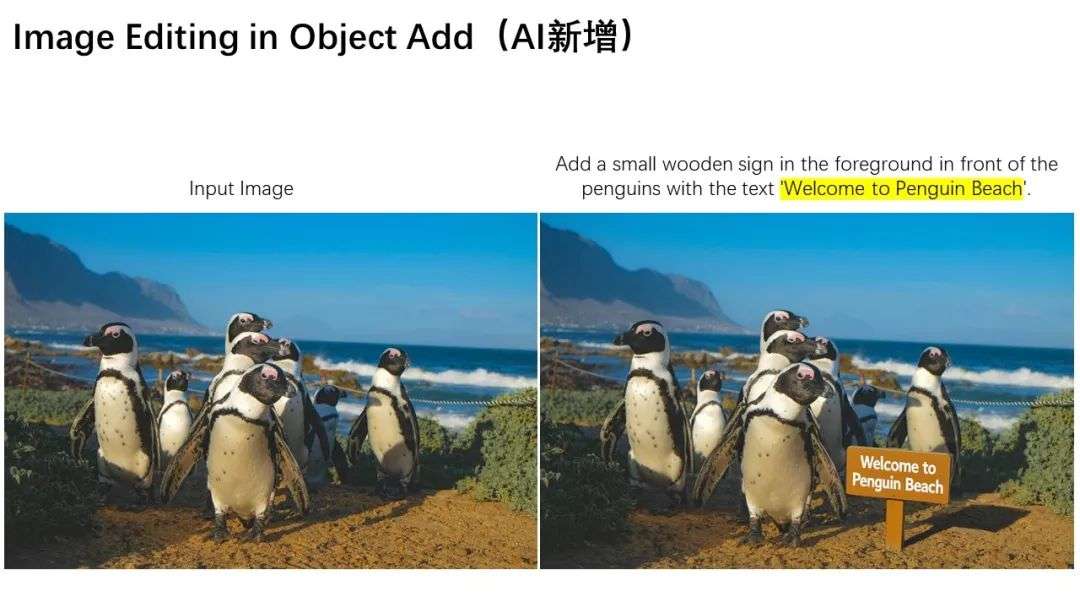

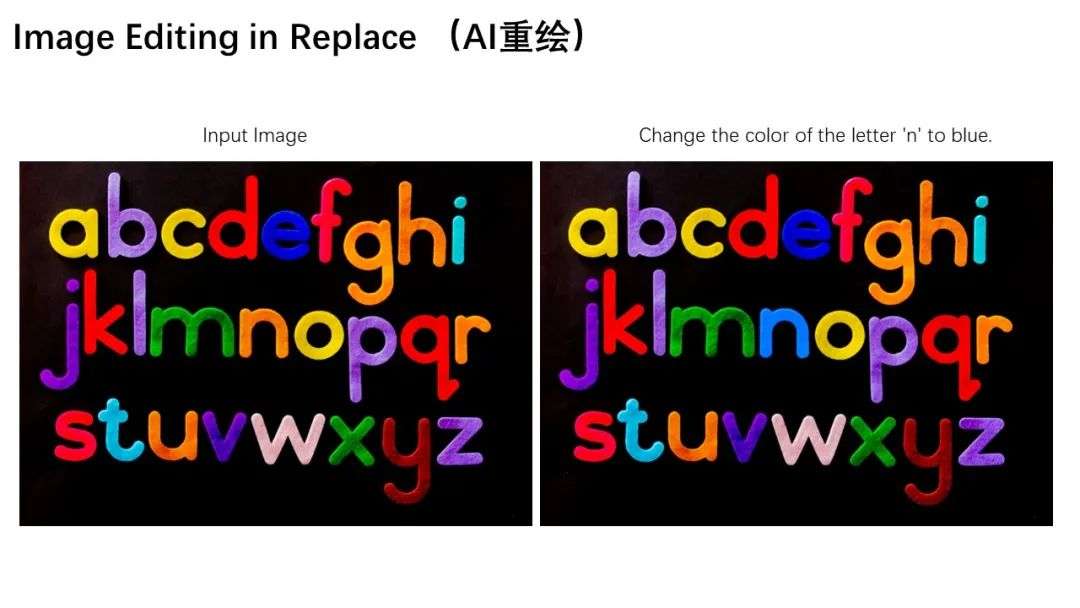

底层视觉外观编辑:可精准添加、删除或修改图像中的特定元素,且能确保图像其他区域完全保持原貌,避免因局部编辑破坏整体画面;

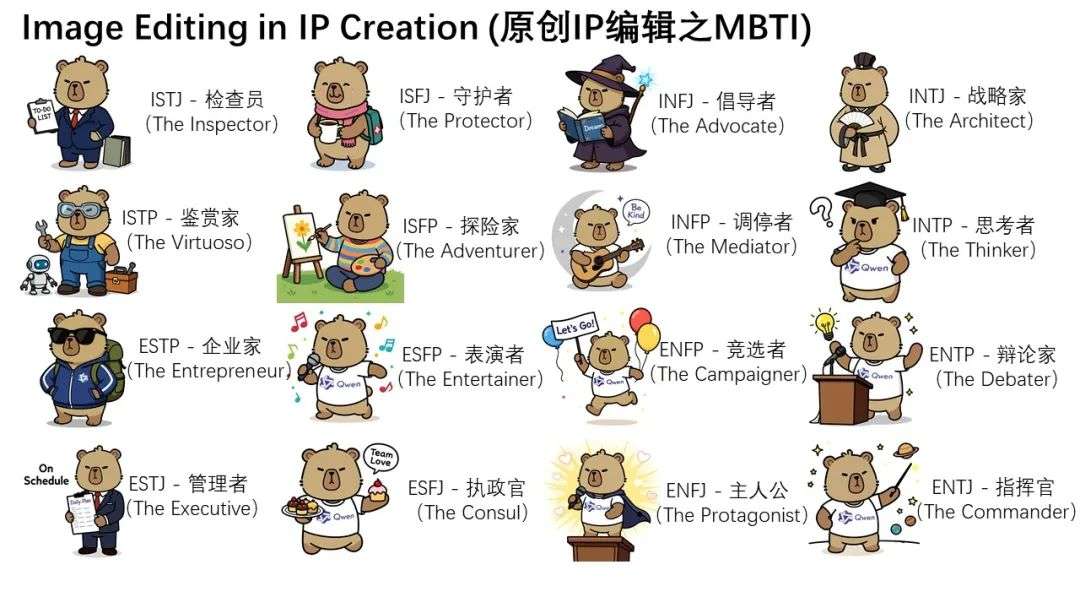

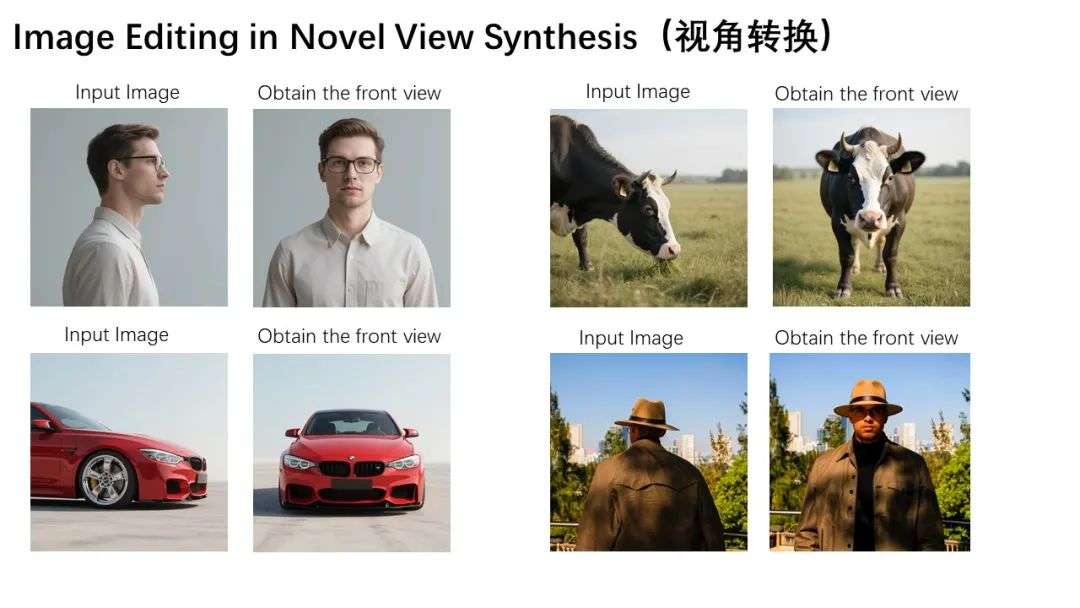

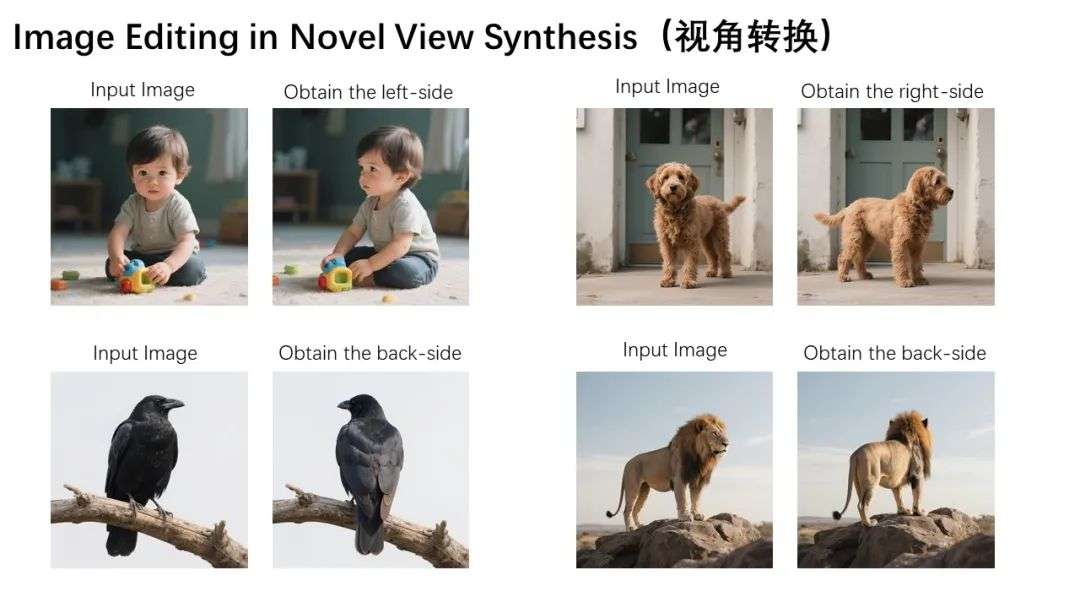

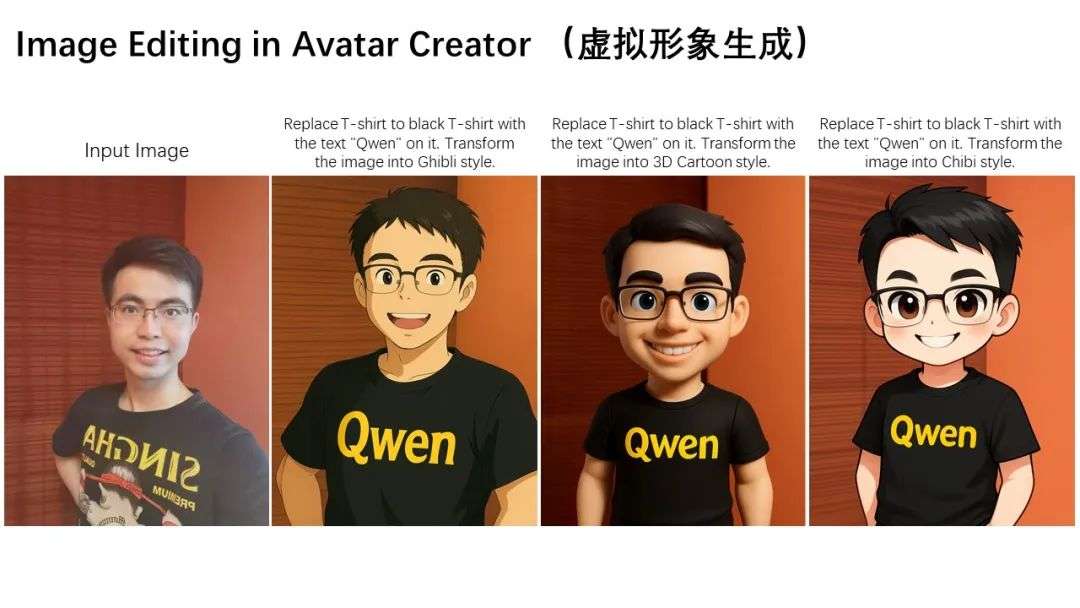

高级视觉语义编辑:覆盖 IP 形象创建、对象旋转、风格迁移等复杂场景,允许整体像素根据编辑需求调整,同时始终保持内容的语义一致性,让创意落地更高效。

2. 中英文双语文本编辑,还原原片风格

针对图像中的文本修改需求,模型支持中英文双语文本的 “增、删、改” 操作,核心优势在于精准还原原文字体、大小与样式—— 无需手动调整格式,修改后的文本能自然融入原图,避免出现字体不匹配、风格割裂等问题,大幅提升文本编辑的效率与质感。

3. 基准性能达 SOTA 水平,实力经得起验证

在多个公共图像编辑基准测试中,Qwen-Image-Edit 的表现均达到当前最先进(SOTA)水平。这一结果证明,该模型不仅具备丰富的功能,更拥有稳定、强劲的技术实力,可作为各类图像编辑应用的可靠基础模型。

镜像站地址:https://hf-mirror.com/Qwen/Qwen-Image-Edit

官方示例:

线上体验方式

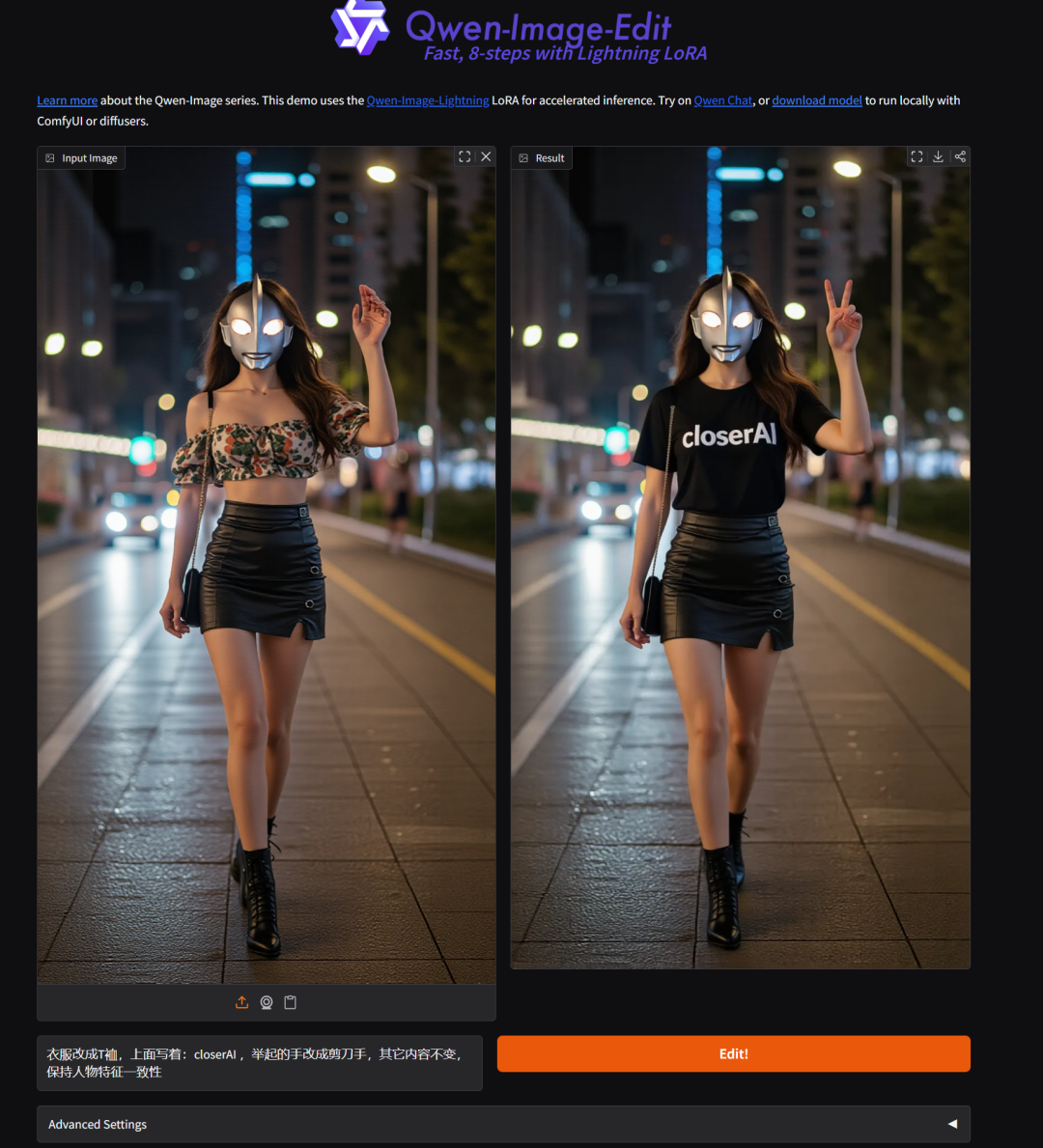

方式一:https://huggingface.co/spaces/multimodalart/Qwen-Image-Edit-Fast

直接上传图像,中文输入指令,点击生成。

示例一:衣服改成T裇,上面写着:closerAI ,举起的手改成剪刀手,其它内容不变,保持人物特征一致性。

这里的一次性给的编辑任务有几个:一是改衣服,二是换手型。它能一次生成!我个人很满意的。

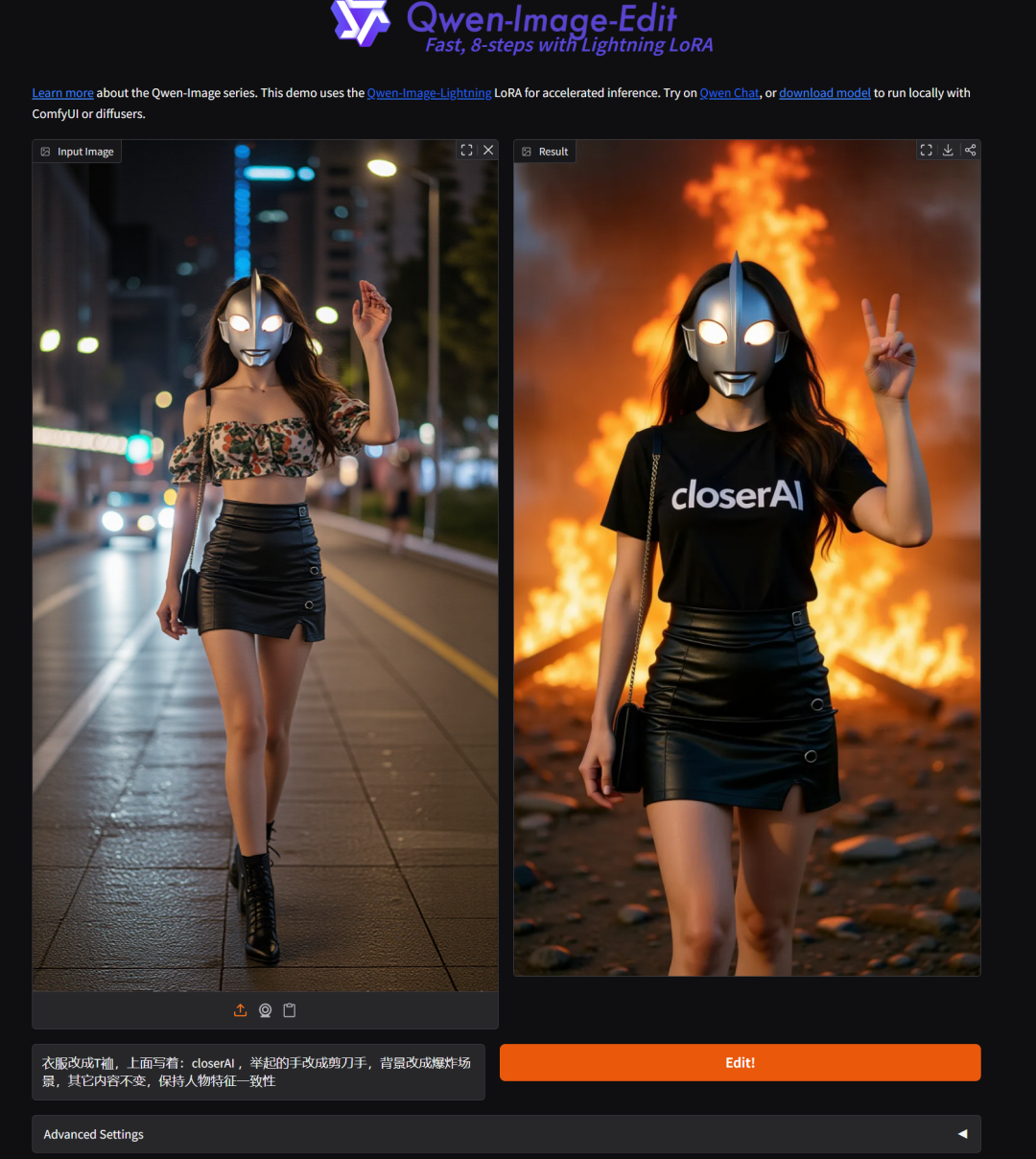

示例二:衣服改成T裇,上面写着:closerAI ,举起的手改成剪刀手,背景改成爆炸场景,其它内容不变,保持人物特征一致性。

在上面示例一的基础上增加了修改背景的任务,同样一次性完成多个编辑任务。

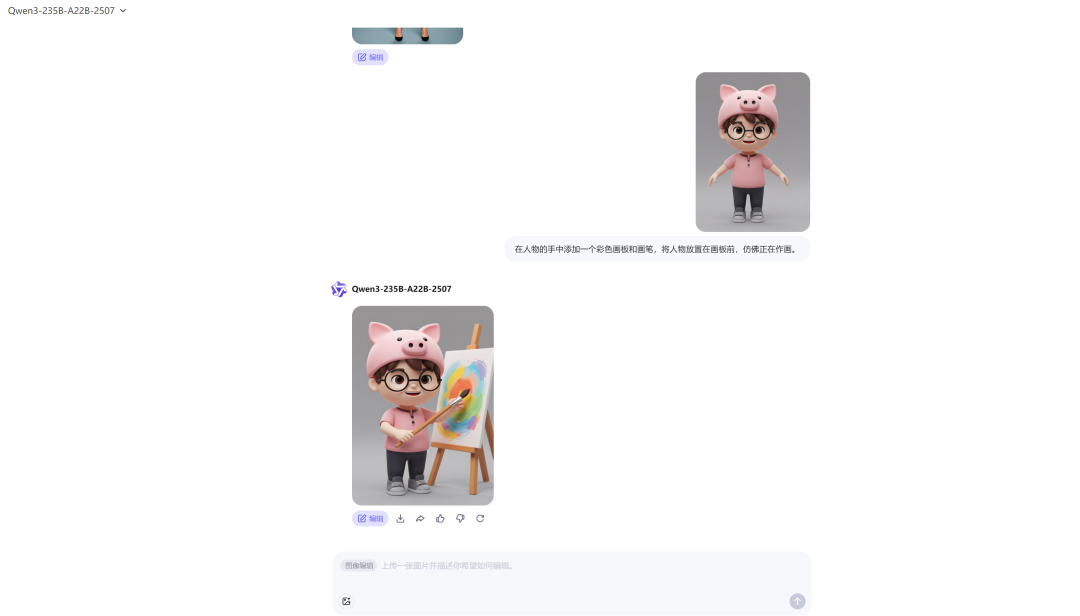

方式二:https://chat.qwen.ai/qwen 上直接体验,选择图像编辑。

输出一张原创IP图,我上传我设计的猪小萌。

提示词:在人物的手中添加一个彩色画板和画笔,将人物放置在画板前,仿佛正在作画。

提示词:在人物的右手边添加一把银色铲子,在人物的左侧附近放置一些蔬菜(胡萝卜、洋葱、青椒)和香料瓶。保持白色背景不变。

以上是在线体验的两种方式。

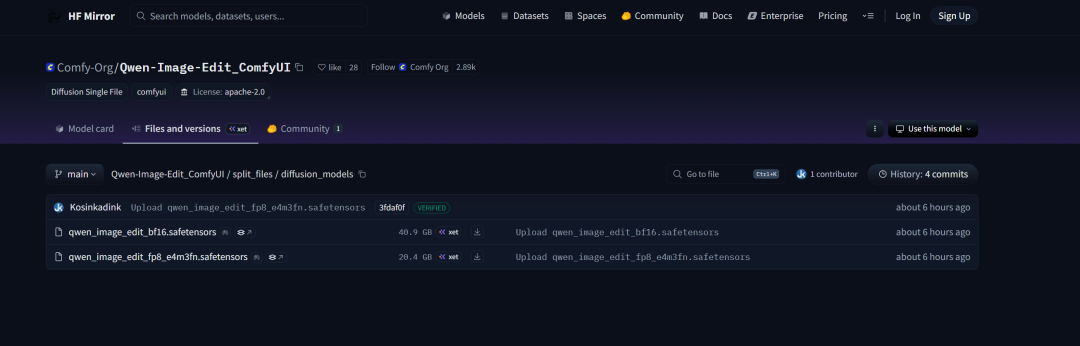

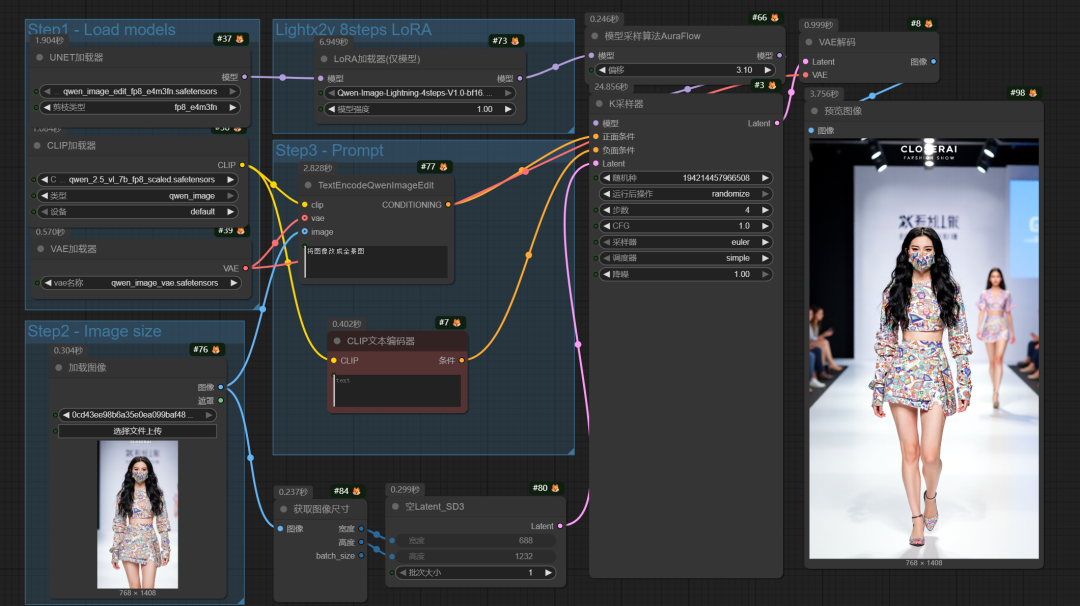

在comfyUI中的体验方式

comfyUI官方已支持:https://hf-mirror.com/Comfy-Org/Qwen-Image-Edit_ComfyUI/tree/main/split_files/diffusion_models

下载模型放diffusion_models下,工作流如下:

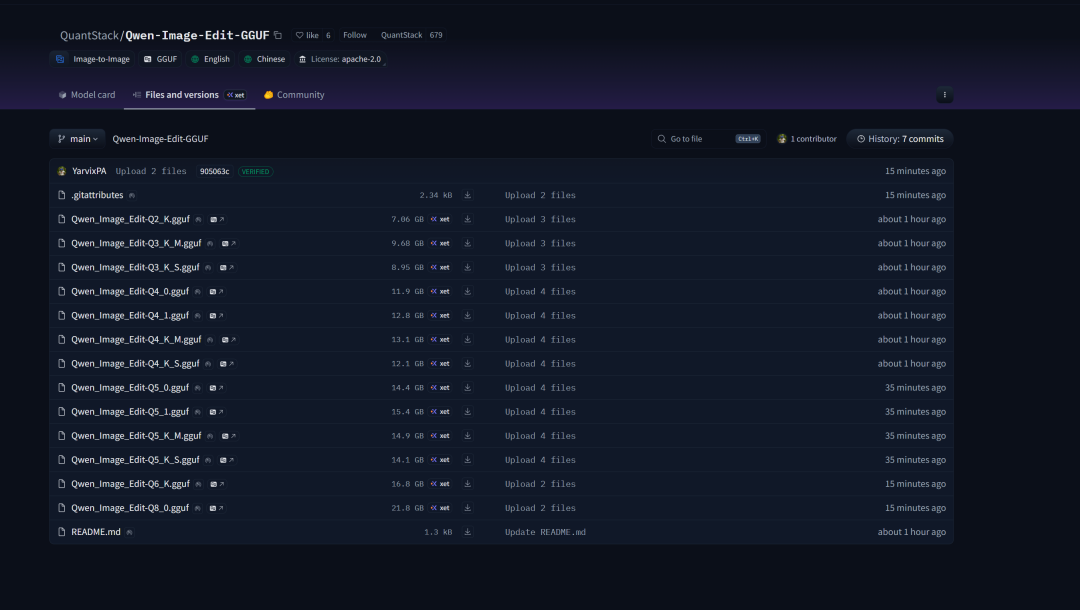

GGUF版本的实现

GGUF已出对应量化版本:

大家根据自己设备情况下载对应的,我这边8G设备,下载Q5的。

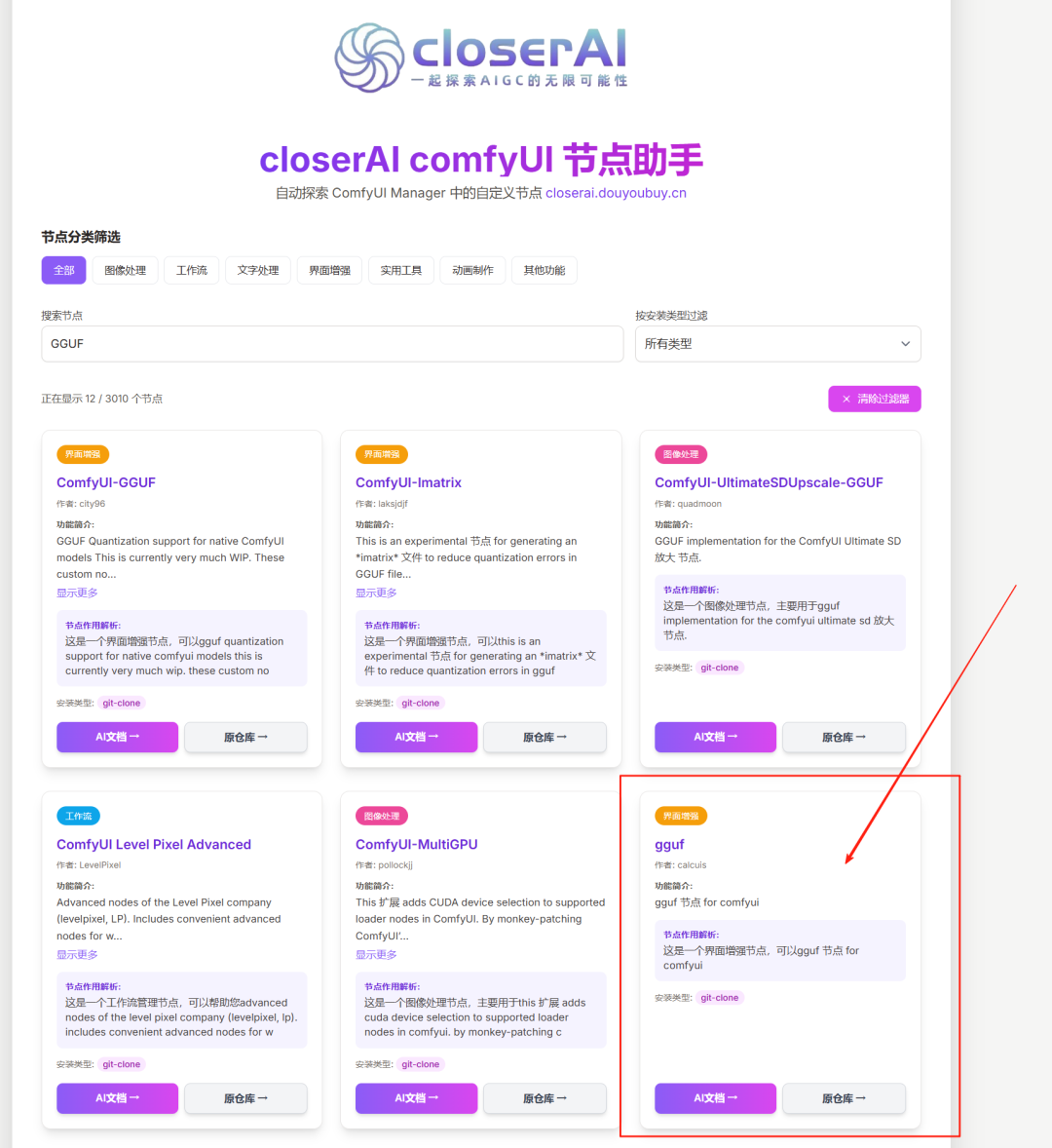

同时大家下载GGUF。GGUF节点主流有两个版本,comfyUI-GGUF暂时应该还没更新,所以加载GGUF版本对应的clip模型会出错。等节点作者更新就好。

那就是不能使用GGUF版本了吗?不是,大家可以下载这个GGUF节点:

https://github.com/calcuis/gguf

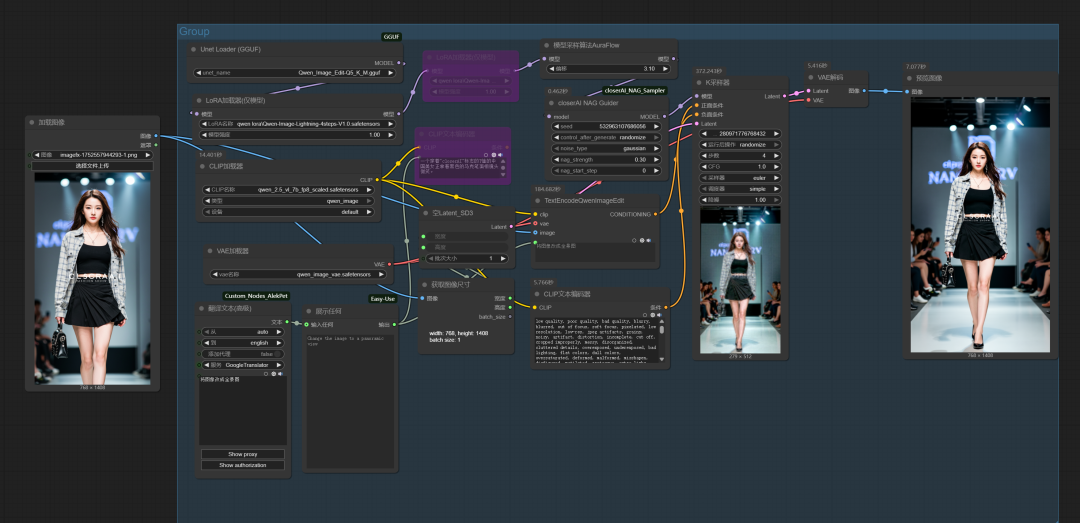

基于官方流,在此基础上修改加载模型节点为GGUF,加载GGUF版本的qwen-image-edit即可。其它clip、VAE不变。工作流如下:

本地算力不够怎么办?

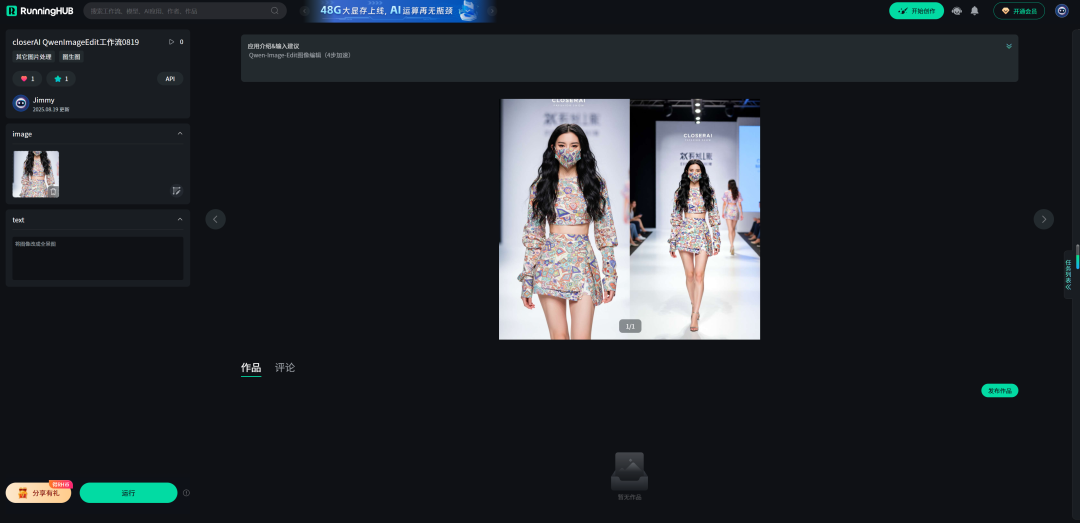

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

阿里千问qwen-image-Edit图像编辑(4步加速)应用体验地址:

https://www.runninghub.cn/ai-detail/1957729600010907649

注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151

通过这个链接第一次注册送1000点,每日登录送100点

最后几句:

我个人感觉非常不错。它的意义与价值在于弥补开源界中文的图像编辑缺口,字与图都能改!这一点非常重要。

抽卡是必然的了,没有一个模型是不需要抽卡的。也没有一个模型是完美的,但它能中文输入,修复中文,同时完成多样编辑任务,这本身就是进步。

以下是我开发的节点,配合kontext能高效出片:

1、comfyUI kontext 标注助手节点:

http://closerai.douyoubuy.cn/2025/07/01/2089/

2、comfyUI kontext提示词生成器节点:

http://aigc.douyoubuy.cn/2025/06/30/2062/

3、closerAI 图像循环助手节点:

http://aigc.douyoubuy.cn/2025/07/05/2137/

4、closerAI 自由组合节点:

http://aigc.douyoubuy.cn/2025/07/24/2305/

5、closerAI 自动白边处理节点:

http://aigc.douyoubuy.cn/2025/07/28/2357/

6、closerAI NAG_Sampler节点:

http://aigc.douyoubuy.cn/2025/07/28/2354/

7、comfyUI kontext提示词生成器网页应用:

http://aigc.douyoubuy.cn/closerai-flux-kontext/

8、closerAI 图像自由组合在线版

http://aigc.douyoubuy.cn/closerai-imagefree/

以下是qwen-image相关节点:

9、closerAI可视化中文编辑节点:

http://aigc.douyoubuy.cn/2025/08/11/2545/

以上是closerAI团队制作的stable diffusion comfyUI closerAI开发的节点以及closerAI qwen-image-edit(GGUF)4步加速工作流介绍,大家可以根据工作流思路进行尝试搭建。

当然,也可以在我们closerAI会员站上获取对应的工作流(查看原文)。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)