在 AIGC 领域,视频生成的“高质量”与“高效率”长期以来是一对难以调和的矛盾。尽管扩散模型(Diffusion Models)已经能生成令人惊叹的视觉效果,但其缓慢的推理速度(通常需要数十秒甚至数分钟来生成几秒钟的视频)极大限制了实时流媒体和交互式应用的可能性。

近日,由华南理工大学、西湖大学、约翰·霍普金斯大学、加州大学默塞德分校及香港中文大学的研究团队联合发布了一项突破性技术——对角蒸馏(Diagonal Distillation)。该技术不仅将生成速度提升了 277.3 倍,更解决了长视频生成中常见的“颜色过饱和”和“运动不一致”等顽疾。

## 1. 行业痛点:为什么视频蒸馏这么难?

传统的扩散模型通过成百上千次的去噪步骤来生成图像或视频。为了提速,业界通常采用“蒸馏”技术将多步模型压缩为少步模型(如 1~4 步)。然而,现有的视频蒸馏方法大多是“图像思维”的延伸,忽略了视频特有的时间依赖性,导致了以下问题:

- 运动一致性降低: 画面在帧与帧之间跳跃,缺乏平滑度。

- 曝光偏差(Exposure Bias): 在自回归生成中,微小的预测误差会随时间累积,导致视频后期出现严重的颜色过饱和或对比度失真。

- 计算瓶颈: 许多模型在判别阶段需要将 Latent 空间解码回像素空间进行光流计算,这会消耗巨大的显存和计算资源。

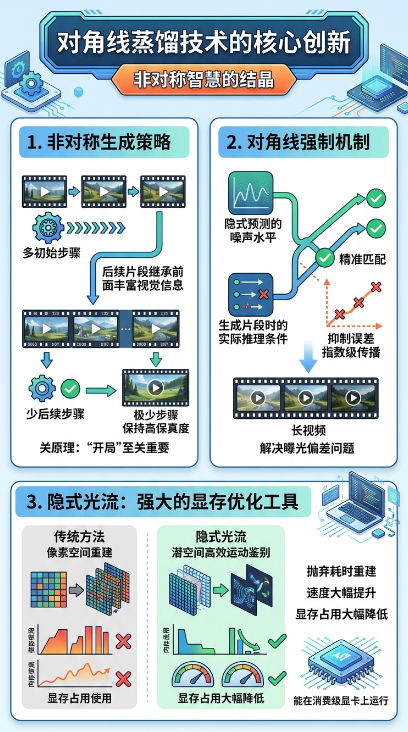

## 2. 核心创新:对角蒸馏的“非对称”智慧

“对角蒸馏”的核心在于它不再一味追求所有片段的同步简化,而是巧妙地利用了时间步与去噪步之间的逻辑关联。

### 非对称生成策略 (Asymmetric Strategy)

研究团队发现,视频的“开场”至关重要。他们提出了一种前期步骤较多、后期步骤较少的设计。这种设计让后续的视频片段能够继承前期片段经过充分处理后获得的丰富外观信息,从而在极少的步数下也能保持高保真度。

### 对角强制 (Diagonal Forcing)

针对长视频常见的“曝光偏差”问题,该研究引入了“对角强制”机制。它通过在片段生成过程中,将后续噪声水平的隐式预测与实际推理条件进行匹配,有效抑制了误差的指数级传播。

### 隐式光流:显存优化利器

对于开发者而言,最令人兴奋的改进之一是隐式光流模型。该方法放弃了耗时的像素空间重建,直接在 Latent Space(隐存空间) 进行高效率的运动判别。这不仅大幅提升了速度,还显著降低了显存占用,使得在消费级显卡上运行超高性能模型成为可能。

## 3. 性能突破:数据会说话

在基于 Wan2.1-1.3B 等主流模型的测试中,对角蒸馏展现了统治级的性能表现:

- 生成速度: 生成 5 秒视频仅需 2.61 秒,帧率高达 31 FPS,达到了真正的“实时级”。

- 长视频稳定性: 即使视频长度延伸至 5 分钟,画面依然稳定,未观察到质量衰减或过饱和现象。

- 量化指标: 通过对饱和度(Saturation)和 RMS 对比度(Contrast)的监测,该方法完美模拟了自然图像的分布。

曝光偏差量化公式:

研究人员通过以下公式对对比度漂移进行了严谨测量:

RMS Contrast=1HW∑j=1H∑k=1W(pjk−μ)2RMS Contrast=HW1∑j=1H∑k=1W(pjk−μ)2

(其中 pjkpjk 为像素灰度值,μμ 为平均亮度)

## 4. 社区反响:下一代“速度型 LoRA”?

该技术在 Reddit 的 r/StableDiffusion 等社区引发了热烈讨论。

- 推理加速的新希望: 许多用户期待这种蒸馏方法能转化为类似“加速插件”或“加速 LoRA”的形式,让普通创作者也能在本地硬件上流畅创作。

- 闭源模型的挑战者: 网友猜测,如果将此技术应用于目前的闭源 SOTA 模型(如 Seedance 2.0 或 Sora),或许能实现视频生成效率的质变。

- 音乐视频制作: 5 分钟的长视频生成能力,让音乐短片(MV)的 AI 全自动化生产看到了落地曙光。

## 5. 总结

对角蒸馏(Diagonal Distillation)不只是简单的提速,它通过对视频生成逻辑的重构,解决了流式自回归生成的底层缺陷。对于像你这样深耕 AIGC 插件开发与优化的开发者来说,其在 Latent 空间的判别逻辑和非对称蒸馏思路,无疑为未来低显存、高性能的 ComfyUI 工作流提供了极佳的参考范式。

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)