更多AI前沿科技资讯,请关注我们:

【closerAI ComfyUI】Seedance 2.0 已经够强,为什么字节还要投入 MammothModa 这样的统一架构?

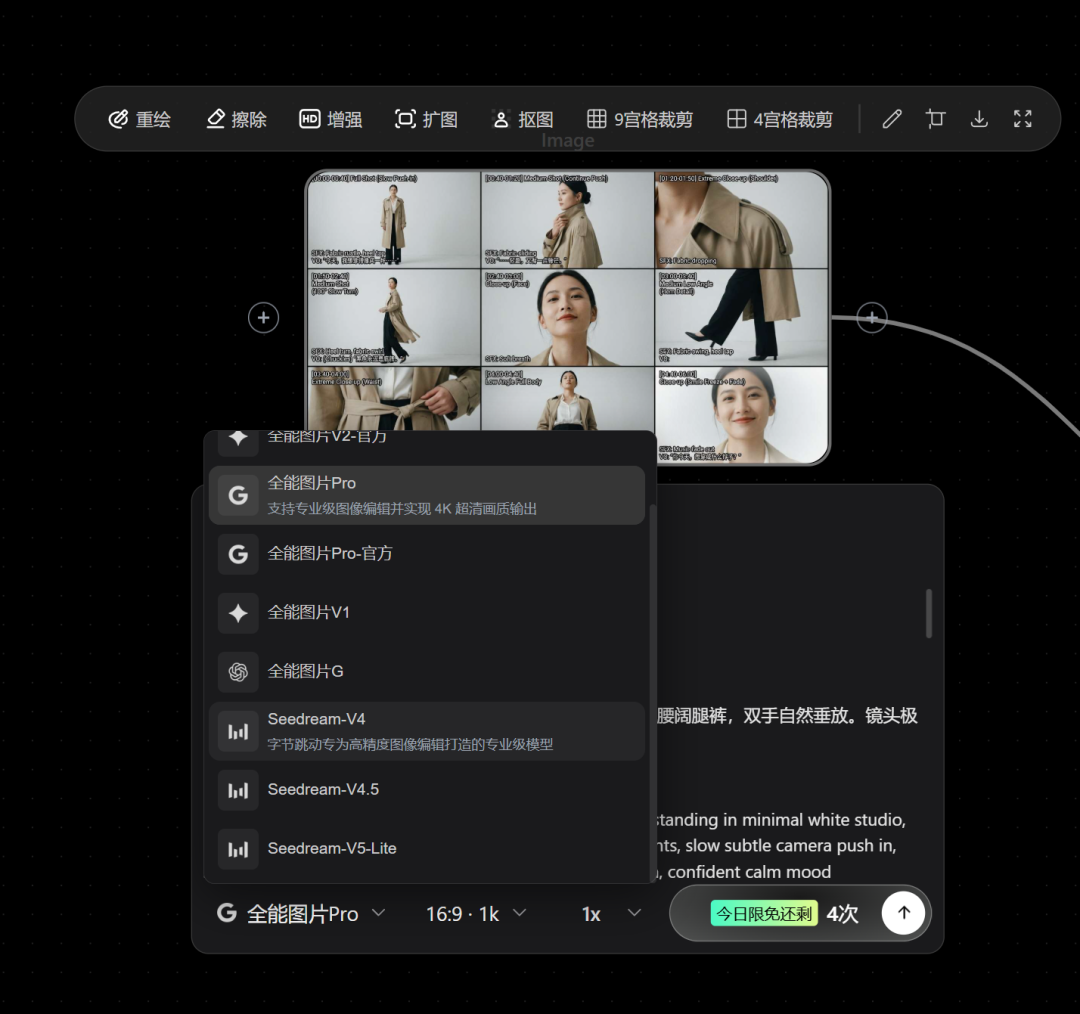

MammothModa视频示例展示

大家好,我是Jimmy。最近,字节跳动在 AI 圈接连投下两枚重磅炸弹:一边是已经商用的 Seedance 2.0,另一边则是突然在 GitHub 上火起来的 MammothModa 项目。很多人把两者混为一谈,但实际上,它们代表了字节在 AI 视频赛道上的两条不同路径。

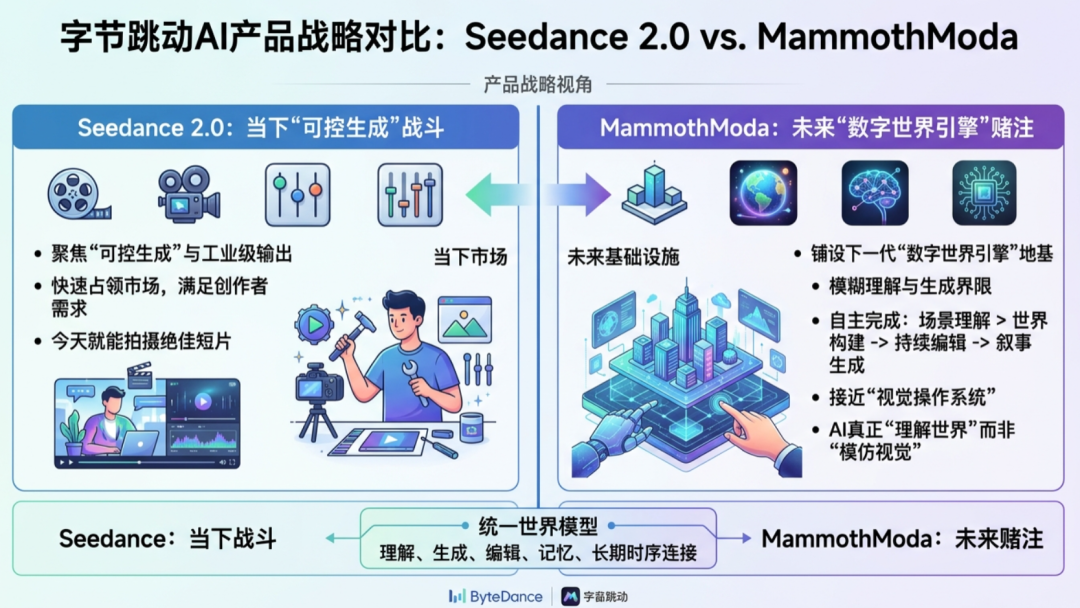

Seedance 2.0 是一款成熟的多模态视频生成工具,支持文本、图像、视频和音频同时输入,能实现多镜叙事、原生音频同步、精确的角色和动作控制。它在实际创作中表现出色,尤其擅长导演级可控性和短视频级工业交付,迅速成为不少创作者和广告团队的趁手武器。它的优势在于落地快、效果稳定、直接可用,已经在商业场景里证明了自己

而 MammothModa 则完全是另一种野心。它并不满足于做一个“好用的视频生成器”,而是试图把文生图、文生视频、图像编辑、视频编辑以及多模态理解全部融合进同一个统一模型里。这不是简单地把 Seedance 的能力再包装一遍,而是从架构底层就选择了完全不同的技术哲学。

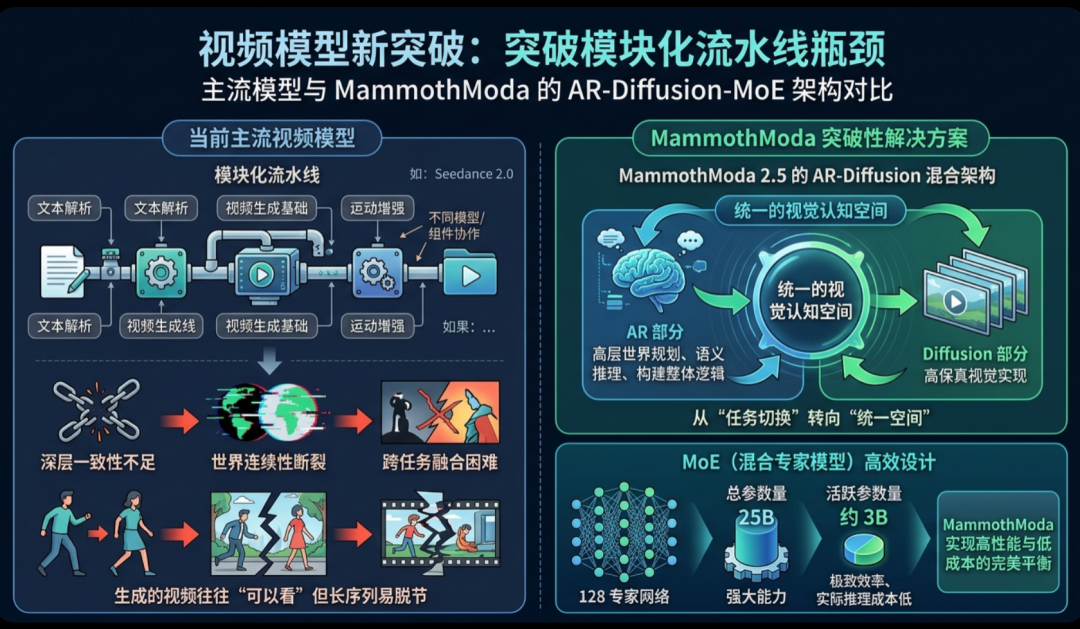

当前主流视频模型,包括 Seedance 2.0 在内,大多还是采用模块化管线思路:不同功能由不同组件或模型协同完成。虽然通过精心优化能达到很高的可用性,但在深层一致性、世界连续性和跨任务融合上仍然存在天然限制。生成的视频往往“能看”,但缺乏真正的物理世界理解,角色、场景和叙事在长序列中容易出现割裂感。

MammothModa 想解决的正是这个根本问题。

其最核心的技术创新在于 AR-Diffusion 混合架构。它以 Qwen3-VL-8B 提供多模态理解能力,结合 MoE Diffusion Transformer(DiT)作为生成骨干。自回归(AR)部分擅长一步步推理、长程一致性和结构化理解;Diffusion 部分则在画质、细节和视觉表现力上占据优势。Mamoda2.5 将两者深度融合:AR 负责高层世界规划、语义建模和叙事逻辑,Diffusion 负责高保真视觉渲染。这种“脑子思考 + 画面呈现”的分工,已非常接近人类创作者的真实工作流程。

另一个关键设计是 MoE(Mixture of Experts) 架构。它配备了 128 个专家网络,通过 Top-8 路由策略动态激活,总参数达到 25B,但实际激活参数仅约 3B。这使得模型既拥有超大规模容量,又显著降低了训练和推理成本。对于视频生成这类极度消耗算力的任务而言,这种设计极具前瞻性。

字节在这一方向上拥有独特数据优势。作为全球短视频巨头,它握有海量连续视频行为数据——不仅包括视频内容,更有用户观看、停留、互动的真实反馈。这让模型能自然习得什么样的镜头节奏更吸引人、什么样的运镜和情绪转折更有传播力,因此字节系模型往往自带浓郁的“短视频感”。

相比 Seedance 2.0 侧重于“可控生成”和工业级输出,MammothModa 更像是在为下一代“数字世界引擎”打基础。它模糊了理解和生成之间的界限,让模型不再需要外部管线就能自主完成从场景理解到世界构建、再到连续编辑和叙事生成的全流程。这已经接近一个视觉操作系统,能让 AI 真正“理解世界”而非仅仅模仿画面。

字节在这两款产品上的布局其实很有意思:Seedance 2.0 负责当前战斗,快速占领市场和满足创作者需求;MammothModa 则在更底层、更长期的统一世界模型方向上押注。Seedance 让你今天就能拍出惊艳短片,而 MammothModa 指向的是未来——一个理解、生成、编辑、记忆和长时序完全打通的 AI 内容基础设施。

开源社区对 MammothModa 格外兴奋,也正是因为它填补了当前开源界少有的“深度统一”空白。字节近年来在开源上持续发力,从 DeerFlow 到 UI-TARS,再到现在的 MammothModa,信号已经非常清晰:他们不只想做最好的视频生成工具,更想造出真正的第二世界。

当然,MammothModa 目前也面临明显挑战——统一架构对硬件要求极高,普通人短期内很难本地跑起来,它更像是平台级的研究与未来能力。而 Seedance 2.0 则已经可以被广泛使用,这也体现了字节一贯的“产品与研究双轮驱动”风格。

生成质量、流畅度和可控性这些指标,很快就会被整个行业快速拉平。真正决定下一阶段胜负的,是谁能最先实现理解、推理、生成和编辑的深度统一。MammothModa 的出现,让人第一次清晰看到字节已经把目光投向了 AI 视频真正的下半场——不再是单纯的“会动的画面”,而是可交互、可理解、可持续演化的数字世界引擎。

字节这次两线并进,格局已远超一时的高清竞赛。AI 圈,真的要变天了。

项目地址:https://github.com/bytedance/mammothmoda

项目页:https://mamoda25.github.io/

论文地址:https://arxiv.org/abs/2605.02641

本地算力不够怎么办?

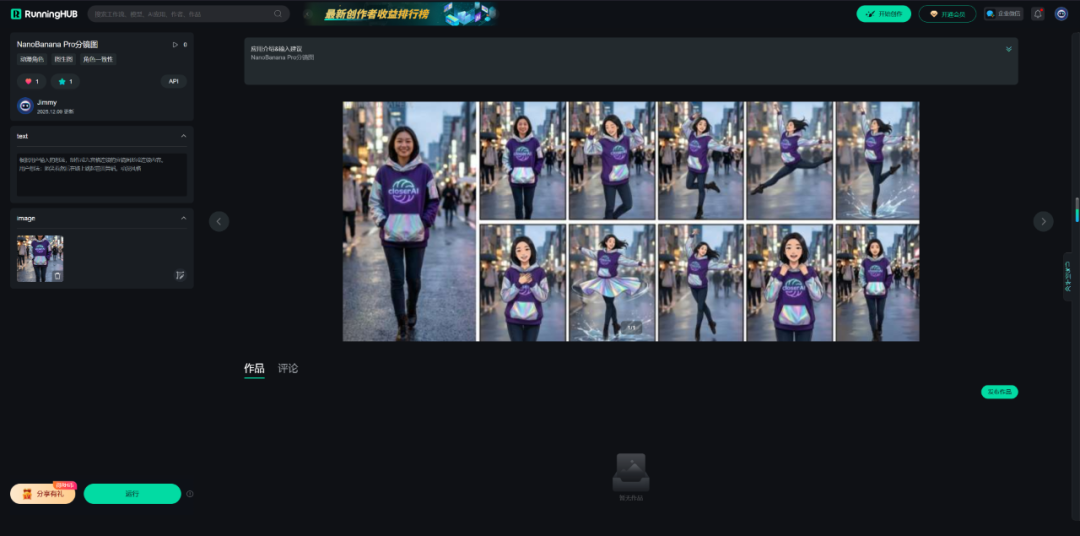

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

NanoBanana Pro分镜图应用体验地址:

注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151

通过这个链接第一次注册送1000点,每日登录送100点

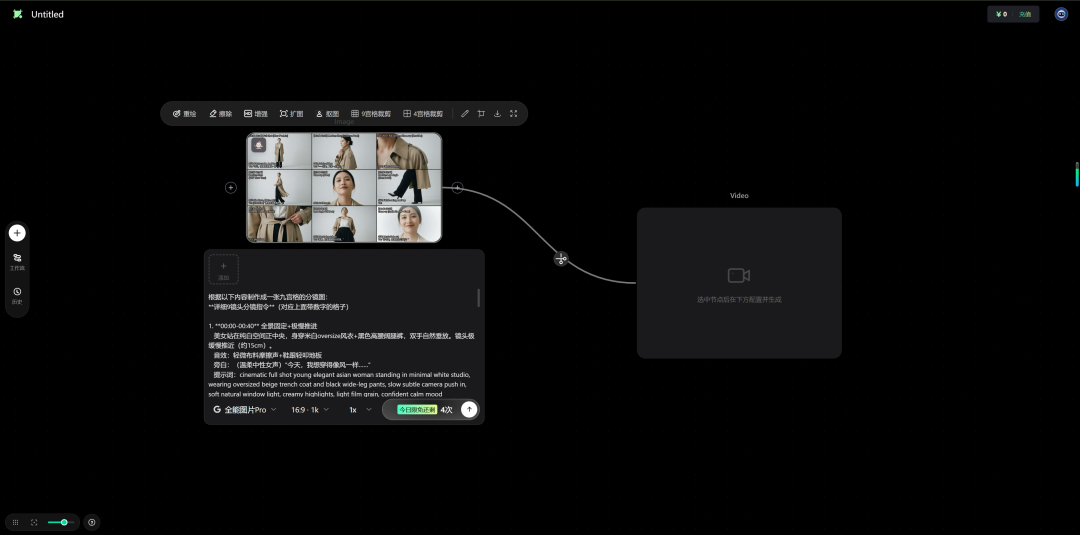

runningHug上的无限画布,也可以使用GPT image进行生成:

它集成了多个优秀的闭源模型:

在图像与视频生成中,一个节点就能直接调用使用并生成。十分方便,且价格优惠。它通过集成闭源模型简化了工作流程直接输入即所得,速度很快。是一个不错的选择。通过注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151 注册后打开无限画面

最后几句:

如果对你有帮助,请一键三连支持下我,感谢

CloserAI AI短剧工作台(本地化解决方案):AI短片/短剧Agent工作台closerAI FlowStudio本地AIGC无限画布创作工具:CLOSERAI FlowStudio无限画布closerAI AI绘画大师万象视界:CLOSERAI VISION万象视界CLOSERAI POD电商印花批量生产工作站: https://aigc.douyoubuy.cn/?page_id=420541 印花提取: https://aigc.douyoubuy.cn/yinhua/

以上是就是本期的分享内容,当然,更多工作流、资讯、插件、工具也可以在我们closerAI会员站上获取(查看原文)。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

主题授权提示:请在后台主题设置-主题授权-激活主题的正版授权,授权购买:RiTheme官网

评论(0)